Come funziona la ricerca: le basi di Google Search

Come funziona la Ricerca di Google? Quante volte ci siamo posti questa domanda, sia dal punto di vista dell’utente “normale” che di chi invece opera nel search marketing? Proviamo quindi ad analizzare in maniera semplice, ma approfondita, il funzionamento del sistema di Ricerca, focalizzandoci in particolare su tutte le indicazioni riguardanti il modo in cui Google scopre le pagine web, ne esegue la scansione e le pubblica, ma anche su ciò che tutto questo significa per i siti e per la SEO.

Che cos’è la Ricerca Google o Google Search

I motori di ricerca sono la versione digitale di un bibliotecario e aiutano l’utente a ottenere le risposte e le informazioni appropriate per la sua query e il suo bisogno scandagliando l’indice completo dei risultati che ha a disposizione.

I search engines sono quindi sono macchine di risposta, database ricercabili di contenuti web, ed esistono per scoprire, comprendere e organizzare i contenuti del Web per offrire i risultati più pertinenti alle domande poste dagli utenti.

In linea di massima, i motori di ricerca sono composti da due parti principali: un indice di ricerca (che rappresenta la libreria digitale di informazioni sulle pagine web) e gli algoritmi di ricerca, vale a dire programmi per computer incaricati di confrontare i risultati dell’Indice di ricerca per individuare quelli più appropriati in base alle regole previste.

Google Search o Ricerca Google è esattamente questo: un motore di ricerca completamente automatizzato che utilizza software, chiamati web crawler, per esplorare regolarmente il Web e trovare pagine da aggiungere al suo Indice. Come ribadito frequentemente, la missione di Google e del suo sistema di ricerca è “organizzare le informazioni di tutto il mondo e renderle accessibili e utili a livello globale”, e ciò richiede un lavoro continuo per mappare continuamente il Web e altre fonti per consentire a ogni utente di accedere alle informazioni che gli algoritmi ritengono più pertinenti e utili, utilizzando come bussola i criteri che solitamente indichiamo come 200 fattori di ranking su Google. I risultati sono poi presentati in vari modi nelle SERP, in base a ciò che è più appropriato per il tipo di informazioni che quella specifica persona sta cercando.

Le statistiche e i numeri di Google

Google ha fatto il suo debutto ufficiale nel 1997 e si è piuttosto rapidamente imposto come “il” motore di ricerca sul Web: attualmente è il sito più visitato al mondo (da svariati anni) ed è così popolare che il suo nome (o un derivato) è diventato sinonimo stesso di ricerca online in diverse lingue, come testimoniano il verbo inglese to google, il tedesco googeln e l’italiano googlare.

I numeri ci aiutano a capire il dominio di questo colosso nel mercato dei search engines: al febbraio 2023, Statcounter certifica che Google detiene il 94% circa dell’intero marketshare di riferimento a livello mondiale, relegando i principali competitor a quote residuali (il secondo motore classificato è Bing, che non arriva al 3% di utenti).

A proposito di cifre e statistiche, poi, sono impressionanti i dati che svelano la mole di lavoro che il motore di ricerca compie ogni istante – che si lega più o meno direttamente anche all’estensione del suo Indice. In particolare, Internet Live Stats conta che Google nel 2023 processa ogni singolo secondo quasi 100mila ricerche, e quindi oltre 8 miliardi e mezzo di ricerche al giorno e oltre 3,1 trilioni su base annua.

Secondo Siteefy, al 4 settembre 2021 Google conteneva circa 25 miliardi di pagine web nel suo indice, mentre World Wide Web Size Project ritiene che il numero stimato di pagine web indicizzate in Google sia di circa 50 miliardi, e a livello assoluto ci sarebbero circa 1.13 trilioni di siti web nel mondo (anche se l’82% di essi risultati inattivo!).

Quindi, ogni volta che immettiamo una query nella casella di ricerca, Google parte ad analizzare “migliaia, a volte milioni, di pagine web o altri contenuti che potrebbero essere una corrispondenza” precisa e pertinente alla nostra intenzione originaria e, grazie ai suoi sistemi, prova a presentare le informazioni più utili in risposta a ciò che gli abbiamo chiesto.

Perché è importante conoscere il funzionamento di Search

Continuiamo a dare ancora un po’ di numeri che ci fanno comprendere il valore di questo enorme sistema: secondo BrightEdge, il 68% di tutte le esperienze online parte da un motore di ricerca e le ricerche organiche sono responsabili del 53,3% di tutto il traffico dei siti web.

Per riuscire a intercettare il traffico organico, però, dobbiamo essere visibili e solo comprendendo le basi della ricerca e della Ricerca Google possiamo riuscire a rendere i nostri contenuti rilevabili per gli utenti: il primo pezzo del puzzle della SEO, però, è assicurarci che i contenuti siano prima di tutto visibili ai motori di ricerca, perché un sito che non può essere trovato e letto dai crawler non potrà mai comparire nelle SERP ed essere cliccato dalle persone.

Sempre a livello generale, poi, è opportuno ricordare e tener presenti due punti chiave legati alla presenza su Google:

- Anche se seguiamo tutte le indicazioni e le linee guida ufficiali Nozioni di base sulla Ricerca Google, Google non garantisce che eseguirà la scansione della pagina, che la indicizzerà o la pubblicherà.

- Nonostante quanto si possa leggere in giro, Google non accetta pagamenti per eseguire con maggiore frequenza la scansione di un determinato sito o per migliorarne il ranking, né c’è legame tra il posizionamento organico e la spesa in advertising sul motore di ricerca.

C’è poi un altro aspetto che non dobbiamo trascurare: il posizionamento non è “eterno”, e non solo perché “Panta rei“, per dirla à la Eraclito: oltre alle inevitabili mutazioni delle tecnologie, ai possibili cambiamenti del search intent e alle trasformazioni del contesto (ad esempio l’emergere di nuovi competitor o le ottimizzazioni di altri siti), è lo stesso motore di ricerca che è in continuo divenire. Come dice Google nella sua guida ai core update, infatti, il team di Big G è sempre al lavoro per perfezionare in modo incrementale l’efficienza del motore di ricerca e garantire agli utenti di trovare sempre le risposte più utili e affidabili: in questo senso, sono ancora i numeri a chiarirci la mole di tali interventi, e soltanto nel 2022 sono stati ufficializzati oltre 800.000 esperimenti, che hanno portato a più di 4000 miglioramenti alla Ricerca (valori in continua crescita, come si verifica facendo un confronto con i dati sulle modifiche nel 2020).

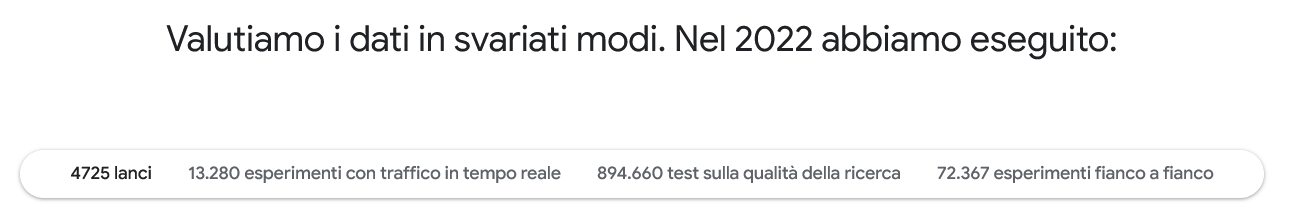

Per la precisione, come si vede nella grafica qui sotto, ci sono stati:

- 4725 lanci (ovvero modifiche effettivamente implementate al termine di un rigoroso processo di revisione da parte di ingegneri e data scientist più esperti di Google).

- 13.280 esperimenti con traffico in tempo reale (per valutare se il coinvolgimento dell’utente rispetto alla nuova funzionalità è positivo e potrà essere utile per tutti).

- 894.660 test sulla qualità della ricerca (con il lavoro dei quality raters, che non influiscono direttamente sul ranking, ma aiutano Google a definire gli standard di qualità dei risultati e a mantenere un alto livello di qualità in tutto il mondo).

- 72.367 esperimenti fianco a fianco (una sorta di test A/B con due gruppi diversi di risultati di ricerca, per capire qual è il preferito tra quello con la modifica prevista e quello “classico”).

Insomma, Search non è un servizio statico e quindi acquisire delle conoscenze di base può aiutarci a stare al passo e a risolvere eventuali problemi di scansione, fare indicizzare le pagine e scoprire come ottimizzare l’aspetto e la presenza del nostro sito nella Ricerca Google – che è poi l’obiettivo finale della SEO, partendo da un assunto intuitivo: migliore è la comprensione del sito da parte di Google, migliore sarà la corrispondenza fornita a chi cerca quel tipo contenuti e risposte.

Le tre fasi della Ricerca Google

Andando ad analizzare in maniera rapida il sistema di Ricerca Google, possiamo individuare tre fasi in cui si articola il processo di ricerca, scoperta e valutazione delle pagine (e non tutte le pagine superano questi passaggi):

- Scansione. Tramite programmi automatizzati chiamati crawler, come ad esempio Googlebot, Google scarica testi, immagini e video dalle pagine trovate su Internet.

- Indicizzazione. Google analizza il testo, le immagini e i file video sulla pagina e memorizza le informazioni nell’Indice Google, il suo grande database. L’indice di ricerca di Google “è come una biblioteca, ma contiene più informazioni di tutte le biblioteche del mondo messe assieme” e viene continuamente ampliato e aggiornato con dati su pagine web, immagini, libri, video, fatti e molto altro.

- Pubblicazione dei risultati di ricerca. Quando un utente esegue ricerche su Google Search, gli algoritmi restituiscono informazioni pertinenti alla sua query in una frazione di secondo: i risultati sono presentati in vari modi, in base a ciò che è più utile per il tipo di informazioni che la persona sta effettivamente cercando.

Come funziona il recupero delle pagine

La prima fase si chiama crawling e serve per capire quali pagine esistono sul Web: come spiega la documentazione ufficiale del motore di ricerca, non esiste un registro centrale di tutte le pagine web, pertanto Google deve costantemente cercare pagine nuove e aggiornate e aggiungerle al proprio elenco di pagine note, facendo ciò che si chiama “Individuazione degli URL”.

Gran parte del lavoro è affidato a software noti come crawler (ma anche robot, bot o spider), che visitano in automatico le pagine web accessibili pubblicamente e seguono i link su tali pagine, proprio come fa un utente che naviga contenuti sul Web; i crawler eseguono la scansione di miliardi di pagine sul web grazie a una quantità enorme di computer, passando da una pagina all’altra e archiviando informazioni su ciò che trovano su tali pagine e altri contenuti accessibili pubblicamente nell’indice della Ricerca Google.

Alcune pagine sono note perché Google le ha già visitate, altre vengono scoperte quando Google segue un link che rimanda da una pagina nota a una nuova – ad esempio, una pagina hub (come una pagina di categoria) che rimanda a un nuovo post del blog – e altre ancora vengono scoperte inviando a Google una Sitemap, ovvero un elenco di pagine per la scansione.

Quando Google trova l’indirizzo URL di una pagina, potrebbe visitare – tecnicamente “sottoporre a scansione” – la pagina per scoprirne i contenuti ed eseguire l’operazione di recupero. In particolare, Googlebot utilizza un processo algoritmico per determinare i siti di cui eseguire la scansione, con quale frequenza farlo e quante pagine recuperare da ogni sito, per evitare di sovraccaricare il sito stesso con troppe richieste. I dati di crawl rate e crawl demand (rispettivamente, la quantità e la frequenza delle richieste di scansione) formano il valore del crawl budget, ovvero il numero di URL che Googlebot può e desidera sottoporre a scansione, che può essere un elemento rilevante per migliorare le opportunità di posizionamento delle nostre pagine più strategiche.

Durante la scansione, Google visualizza la pagina ed esegue eventuale codice JavaScript rilevato utilizzando una versione recente di Chrome, in modo simile a come il browser visualizza la pagina che visitiamo. Il rendering è importante perché i siti web spesso si affidano a JavaScript per mostrare i contenuti sulla pagina e, senza il rendering, Google potrebbe non vedere questi contenuti.

Ad ogni modo, Googlebot non esegue la scansione di tutte le pagine che ha rilevato: alcune risorse potrebbero essere non autorizzate per la scansione dal proprietario del sito, altre potrebbero non essere accessibili senza che venga effettuato l’accesso al sito. Nello specifico, ci sono almeno tre problemi comuni di accesso ai siti da parte di Googlebot, che impediscono il crawling:

- Problemi con il server che gestisce il sito

- Problemi di rete

- Regole del file robots.txt che impediscono l’accesso alla pagina da parte di Googlebot

Gli autori di contenuti e proprietari/gestori di siti possono aiutare Google a scansionare meglio le loro pagine usando i report contenuti nella Search Console o attraverso i citati servizi standard consolidati, quali le Sitemap o il file robots.txt, che specificano la frequenza con cui i crawler dovrebbero visitare i contenuti o eventualmente escludere determinate pagine e risorse dall’indice di ricerca.

Di base, ci sono varie ragioni che ci possono convincere a bloccare i crawler dei motori di ricerca da una parte o da tutto il sito o istruire i motori di ricerca affinché evitino di memorizzare determinate pagine nel loro indice. Se però vogliamo che i nostri contenuti vengano trovati dagli utenti di Search è cruciale renderli accessibili ai crawler e indicizzabili, altrimenti il nostro sito rischia di essere praticamente invisibile.

Dettagli tecnici sul crawling

Proseguendo con la metafora della biblioteca, secondo Lizzy Harvey il crawling è “come leggere tutti i libri della biblioteca”. Prima che i motori di ricerca possano mostrare qualsiasi risultato di ricerca, infatti, devono reperire quante più informazioni possibili dal web e, per questo, utilizzano un crawler, un programma che viaggia da un sito all’altro e si comporta come un browser.

I crawler tentano di recuperare ogni URL per determinare lo stato del documento e assicurare che solo documenti accessibili pubblicamente entrino nell’indice: se un libro o un documento è mancante o danneggiato, il crawler non può leggerlo; se invece la risorsa restituisce un codice di stato di errore, i crawler non possono utilizzare nessuno dei suoi contenuti e potrebbero riprovare l’URL in un secondo momento.

In particolare, se i crawler scoprono un codice di stato di redirect (come 301 o 302), seguono il reindirizzamento a un nuovo URL e continuano lì; quando ottengono una risposta positiva, segno che hanno trovato un documento accessibile agli utenti, controllano se è consentito eseguire la scansione e quindi scaricano il contenuto.

Questo controllo include l’HTML e tutti i contenuti menzionati nell’HTML, come immagini, video o JavaScript. I crawler estraggono anche i collegamenti dai documenti HTML per visitare anche gli URL linkati visto che, come dicevamo prima, seguire i collegamenti è il modo in cui i crawler trovano nuove pagine sul Web. A proposito dei link, nelle vecchie versioni del documento di Google si leggeva un riferimento esplicito al fatto che “i link all’interno delle pubblicità, i link per i quali hai pagato su altri siti, i link nei commenti e altri link che non rispettano le Linee Guida non vengono seguiti” – ora sparito, anche se quasi certamente il funzionamento è rimasto identico.

È comunque importante sapere che i crawler non fanno clic attivamente su link o pulsanti, ma inviano gli URL a una coda per eseguirne la scansione in un secondo momento; inoltre, quando si accede a un nuovo URL, non sono disponibili cookie, service worker o storage locale (come IndexedDB).

L’indicizzazione, ovvero l’organizzazione delle informazioni

Dopo aver trovato una pagina web, i crawler ne analizzano il contenuto, provando a capire di che cosa tratta e organizzando la raccolta di informazioni di Google: è la fase che si chiama indicizzazione, in cui i crawler visualizzano i contenuti della pagina come farebbe il browser e prendono nota dei segnali principali, anche attraverso l’elaborazione e l’analisi dei contenuti testuali e di tag di contenuti chiave e attributi, come gli elementi <title> e gli attributi ALT, immagini, video e altro ancora.

L’indice della Ricerca Google contiene centinaia di miliardi di pagine web e le sue dimensioni superano i 100.000.000 di gigabyte: è come l’indice alla fine di un libro e presenta una voce per ogni parola visualizzata su ciascuna pagina web che è stata indicizzata. Quando Google indicizza una pagina web, infatti, la aggiunge alle voci per tutte le parole che contiene.

Poiché il Web e altri contenuti cambiano costantemente, i processi di scansione del motore di ricerca sono in continua esecuzione per tenere il passo, apprendendo la frequenza con cui contenuti già esaminati vengono modificati e scansionandoli se necessario, e scoprendo anche nuovi contenuti man mano che vengono visualizzati nuovi link a tali pagine o informazioni.

Un aspetto curioso è che l’indice di ricerca Google contiene più di ciò che è presente sul Web, come affermano le documentazioni dello stesso motore di ricerca, perché ” le informazioni utili possono essere disponibili presso altre fonti“. Di fatto, esistono più indici per diversi tipi di informazioni, che vengono raccolte tramite scansione, collaborazioni, invio di feed di dati e attraverso l’enciclopedia dei fatti di Google, il Knowledge Graph. Questi diversi indici permettono a un utente di cercare all’interno di milioni di libri provenienti dalle più grandi raccolte, trovare orari di viaggio tramite un’azienda di trasporto pubblico locale o trovare dati forniti da fonti pubbliche come la World Bank.

Dettagli tecnici sull’indicizzazione

Dal punto di vista tecnico, la procedura di indicizzazione avviene con una scansione completamente automatizzata, senza intervento umano, e ogni web crawler lavora in modo specifico, utilizzando il sistema di apprendimento automatico previsto dall’algoritmo del suo motore di ricerca.

Questa fase serve anche a Google per determinare se una pagina è un duplicato di un’altra pagina su Internet o se è una pagina canonica, quella che può essere mostrata nei risultati di ricerca come più rappresentativa di un clustering di pagine con contenuti trovate su Internet (le altre pagine nel gruppo, ricordiamo, vengono considerate versioni alternative e potrebbero essere pubblicate in contesti diversi, ad esempio se l’utente sta effettuando ricerche da un dispositivo mobile o sta cercando una pagina molto specifica di quel cluster).

L’indicizzazione non è garantita e non tutte le pagine elaborate da Google sono poi effettivamente indicizzate. Questo può dipende anche dai contenuti della pagina e dai relativi metadati, e tra i principali problemi di indicizzazione citiamo:

- Bassa qualità dei contenuti sulla pagina.

- Regole del meta tag Robots che non consentono l’indicizzazione.

- Design del sito web che potrebbe rendere difficile l’indicizzazione.

È ancora Lizzy Harvey a fornisci altri elementi di analisi su questa attività, che inizia quando il crawler, dopo aver recuperato un documento, passa il contenuto al motore di ricerca per aggiungerlo all’indice: a questo punto, il motore di ricerca esegue il rendering (ovvero, in estrema sintesi, visualizza il codice della pagina come farebbe un browser, con alcune limitazioni, per capire come appare agli utenti) e analizza il contenuto per comprenderlo.

Nello specifico, i motori di ricerca esaminano una serie di segnali che descrivono il contenuto e il contesto della pagina, come ad esempio le parole chiave, il titolo, i collegamenti, gli heading, il testo e molte altre cose, che permettono agli stessi motori di ricerca di rispondere a qualsiasi query con la migliore pagina possibile.

Un ultimo chiarimento: l’Indice rappresenta comunque una sorta di database di siti Web pre-approvati da Google, che ha controllato le fonti e le informazioni e ritenuto quelle pagine sicure per i suoi utenti. Quindi, cercare su Google (e in generale cercare su un motore di ricerca) non significa cercare all’interno dell’intero World Wide Web né cercare su tutto Internet (ad esempio, le nostre query non ci porteranno a risultati dal famoso e famigerato dark web), ma cercare all’interno delle pagine selezionate dai web crawler di quel motore di ricerca specifico, in un database ristretto.

Il ranking e la pubblicazione dei risultati della ricerca

L’ultima attività prende il via quando una persona inserisce una query: i computer di Google cercano le pagine corrispondenti nell’indice, poi restituiscono i risultati ritenuti più utili, di migliore qualità e più pertinenti per quella query. Il posizionamento o l’ordinamento delle pagine avviene in base alla query, ma spesso l’ordine può cambiare nel tempo se diventano disponibili informazioni migliori.

In generale, si può presumere che più alto è il ranking di una pagina, più pertinente il motore di ricerca ritiene che quella pagina e quel sito siano rispetto alla query.

Data la grande quantità di informazioni disponibile, trovare quello che cerchiamo sarebbe praticamente impossibile senza uno strumento che organizzi i dati: i sistemi di ranking di Google sono progettati proprio a questo scopo e, tramite generazione automatica, ordinano centinaia di miliardi di pagine web e altri contenuti nell’indice di ricerca per fornire risultati utili e pertinenti in una frazione di secondo.

La pertinenza viene stabilita tenendo in considerazione centinaia di fattori, come ad esempio la posizione, la lingua e il dispositivo dell’utente (computer o telefono) – ad esempio, la ricerca di “officine per la riparazione di biciclette” mostra risultati diversi a un utente di Parigi rispetto a un utente di Hong Kong.

Questo lavoro extra serve ad assicurare più della semplice corrispondenza della query con le parole chiave nell’indice, e per fornire risultati utili, Google potrebbe prendere in considerazione il contesto, la formulazione alternativa e altro ancora: ad esempio, “silicon valley” potrebbe riferirsi alla regione geografica o al programma televisivo, ma se la query è “silicon valley cast”, i risultati sulla regione non sarebbero molto utili. Altre query possono essere indirette, come “la canzone in pulp fiction”, e i motori di ricerca devono interpretare l’intento dell’utente e mostrare i risultati per le tracce musicali presenti nel film.

Sempre a proposito di fattori, le parole usate nella ricerca, la pertinenza e l’usabilità delle pagine, l’affidabilità delle fonti e le impostazioni del dispositivo dell’utente possono influenzare l’aspetto delle informazioni mostrate in SERP. L’importanza attribuita a ogni fattore cambia in base al tipo di ricerca: ad esempio, la data di pubblicazione dei contenuti ha un ruolo più incisivo nel rispondere a ricerche relative ad argomenti di attualità piuttosto che a ricerche riguardanti le definizioni del dizionario, come sancito dal cosiddetto algoritmo Query Deserves Freshness.

Come già evidenziato negli specifici approfondimenti, Google individua cinque grandi categorie di fattori principali che determinano i risultati di una query, ovvero:

- Significato.

- Pertinenza.

- Qualità.

- Usabilità.

- Contesto.

Ci sono poi casi in cui una pagina è indicizzata e viene riconosciuta come indicizzata da Search Console, ma non la vediamo comparire nei risultati di ricerca; le cause di questo fenomeno potrebbero essere le seguenti:

- I contenuti della pagina non sono pertinenti per le query degli utenti.

- La qualità dei contenuti è bassa.

- Le regole del meta tag Robots impediscono la pubblicazione.

Il perfezionamento dei risultati e le funzionalità delle SERP

Le funzionalità di ricerca visualizzate nella pagina dei risultati di ricerca cambiano anche in base alla query dell’utente. Ad esempio, la ricerca di “officine per la riparazione di biciclette” mostrerà probabilmente risultati locali e nessun risultato di immagini; tuttavia, è probabile che la ricerca di “bicicletta moderna” mostrerà risultati relativi a immagini, non a risultati locali.

Anche la comparsa di box, feature e funzionalità aggiuntive serve a completare la missione del motore di ricerca, e quindi a risolvere la query del ricercatore nel modo più rapido ed efficace possibile: l’esempio più noto sono i featured snippet (brevi estratti in evidenza rispetto ai link organici che rispondono sinteticamente alla richiesta dell’utente), le Local Map, i rich results (i risultati multimediali arricchiti rispetto ai classici snippet testuali) e i knowledge panel, ma l’elenco delle feature è enorme e in costante crescita, come mostra il nostro approfondimento sulla galleria dei risultati mostrati nelle SERP di Google attraverso le informazioni reperite dai dati strutturati.

Sito, documenti e pagine: il vocabolario di Google

Tornando a guardare la vecchia versione del documento di Google (ora sparita) era interessante la sezione “Che cos’è un documento?”, che descriveva in particolare il meccanismo usato per determinare cosa fosse un documento per Google, con dettagli su come il sistema visualizzasse e gestisse più pagine con contenuti identici a un singolo documento, anche con URL diversi, e come determinasse gli URL canonici.

Partendo dalle definizioni, scopriamo quindi che “internamente, Google rappresenta il Web come un insieme (enorme) di documenti. Ciascun documento rappresenta una o più pagine web”, che possono essere “identiche o molto simili, ma rappresentano essenzialmente gli stessi contenuti, raggiungibili da URL diversi”. In dettaglio, “i diversi URL in un documento possono rimandare esattamente alla stessa pagina o alla stessa pagina con piccole varianti destinate a utenti su dispositivi diversi”.

Google “sceglie uno degli URL in un documento e lo definisce come URL canonico del documento”: sarà “quello di cui Google esegue più spesso la scansione e l’indicizzazione”, mentre “gli altri URL sono considerati duplicati o alternativi e possono essere occasionalmente sottoposti a scansione o pubblicati in base alla richiesta dell’utente”. Ad esempio, “se l’URL canonico è l’URL per i dispositivi mobili, Google probabilmente pubblicherà comunque l’URL desktop (alternativo) per gli utenti che eseguono ricerche su desktop”.

Focalizzandoci sul glossario, in particolare, in Google Search i seguenti termini hanno questo specifico significato:

-

- Documento è una raccolta di pagine simili, che “include un URL canonico ed eventualmente URL alternativi, se il tuo sito ha pagine duplicate”. Google sceglie l’URL migliore da mostrare nei risultati di ricerca in base alla piattaforma (dispositivo mobile/desktop), alla lingua dell’utente (le versioni hreflang sono considerate documenti distinti, si spiega), alla località e a molte altre variabili. Google “rileva le pagine correlate sul tuo sito tramite la scansione organica o tramite funzionalità implementate sul sito, come i reindirizzamenti o i tag <link rel=alternate/canonical>”, mentre “le pagine correlate di altre organizzazioni possono essere contrassegnate come alternative solo se codificate in modo esplicito dal tuo sito (tramite reindirizzamenti o tag link)”.

- URL è “l’URL utilizzato per raggiungere un determinato contenuto su un sito” e si chiarisce che un sito “potrebbe risolvere URL diversi nella stessa pagina”.

- Pagina fa riferimento a “una determinata pagina web, raggiunta mediante uno o più URL”, e possono “esistere diverse versioni di una pagina, a seconda della piattaforma dell’utente (dispositivo mobile, desktop, tablet e così via)”.

- Versione indica “una variante della pagina, generalmente classificata come mobile, desktop e AMP (anche se AMP può avere a sua volta versioni per dispositivi mobili e desktop)”. Ogni “versione può avere un URL diverso o identico a seconda della configurazione del sito” e si ribadisce ancora che “le varianti linguistiche non sono considerate versioni diverse, bensì documenti diversi”.

- Pagina o URL canonico è “l’URL che Google considera più rappresentativo del documento”, di cui Google esegue sempre la scansione, mentre “la scansione degli URL duplicati nel documento viene eseguita occasionalmente”.

- Pagina o URL alternativo/duplicato è “l’URL del documento di cui Google potrebbe occasionalmente eseguire la scansione”, che sono pubblicati se Google li riconosce “adatti all’utente e alla richiesta (ad esempio, per le richieste desktop verrà pubblicato un URL alternativo per gli utenti desktop, anziché un URL canonico per dispositivi mobili)”.

- Sito, termine “in genere utilizzato come sinonimo di sito web (un insieme di pagine web concettualmente correlato), ma talvolta utilizzato come sinonimo di una proprietà Search Console, sebbene una proprietà possa essere definita in effetti solo come parte di un sito. Un sito può includere sottodomini (e persino organizzazioni, per pagine AMP collegate correttamente)”.

Come funziona la Ricerca su Google: sintesi e nozioni di base

Per ricapitolare questo enorme e complesso meccanismo possiamo far riferimento all’episodio numero 4 della serie “Search for Beginners” che Google ha pubblicato sul suo canale YouTube per chiarire i principali dubbi su come funziona la Ricerca su Google e, in particolare, per offrire le definizioni semplici di scansione, indicizzazione e posizionamento, che abbiamo detto essere le tre fasi principali del processo.

Come nei precedenti episodi, il target sono innanzitutto i siti di business online, ma le informazioni su come il motore di ricerca esegue il crawling per scoprire le pagine web, organizza nell’Indice i risultati e li classifica per mostrarli a utenti e potenziali clienti possono essere utili per qualsiasi tipo di attività sul Web.

Come funziona il sistema della Ricerca di Google

Si parte da un concetto di base: la Ricerca di Google “è uno strumento potente”, che permette alle persone di “trovare, condividere e accedere a una quantità quasi infinita di contenuti, indipendentemente da come e dove si colleghino”. Quindi, “se avete un’impresa online e volete che i clienti vi trovino”, capire come funziona il motore di ricerca è essenziale.

Prima di tutto, Google deve “capire che la vostra impresa ha una presenza sul web”: che sia un sito, un blog, un profilo su un social media o una scheda sull’ormai ex Google My Business, “Google compie un viaggio per trovare la vostra impresa, categorizzarla e mostrarla ai vostri potenziali clienti“, ci ricorda il video.

La scansione del Web per trovare nuovi contenuti

La prima fase fondamentale di questo processo è quella della scansione: “Google cerca costantemente nuovi contenuti da aggiungere al suo gigantesco catalogo” attraverso un’attività di scoperta che si chiama crawling. In genere, ci spiega la voce guida, “Google scopre pagine web seguendo link da pagina a pagina”, trovando così nuovi contenuti che non aveva mai visto prima.

L’intervento di Googlebot

Quando Googlebot trova un nuovo sito “deve capire di cosa tratta il contenuto“: questo processo si chiama indexing. In poche parole, questo significa che “proprio come si organizza l’inventario di un negozio, che sia di scarpe, maglioni o vestiti, Google analizza il contenuto della vostra pagina e salva queste informazioni nel suo indice“, che è considerato il più grande database al mondo.

Terza fase: il posizionamento

Completati i primi due processi tecnici, cosa succede dopo che “Google avrà trovato il tuo sito e Googlebot sa che hai un negozio online che vende vestiti”? È il momento di parlare di ranking: quando un utente lancia una query di ricerca, i sistemi di Google passano in rassegna centinaia di miliardi di pagine web nell’indice di ricerca, cercando i risultati più utili e rilevanti in una frazione di secondo.

Una classica ricerca genera migliaia, o addirittura milioni di pagine web che propongono informazioni potenzialmente rilevanti: il compito di Google è “determinare le risposte migliori e più rilevanti, fornendo contenuti che offrano la migliore user experience e i risultati più appropriati”.

Fattori di ranking e fattori utente per il ranking

Oltre ai classici fattori di ranking, ci sono altri elementi che incidono sulla determinazione dei risultati come “la posizione geografica dell’utente, la lingua e il tipo di dispositivo” utilizzati, ci dice il video. Per esempio, la ricerca “comprare una bella shirt” potrebbe mostrare risultati diversi per un utente che cerca a New York rispetto a uno che abita a Miami: in particolare, nel primo caso servirà una camicia a maniche lunghe, mentre in Florida probabilmente è più utile una maglietta leggera.

La differenza tra risultati organici e a pagamento

Ciò che bisogna ricordare, sottolineano da Big G, è che “i risultati di Google Search sono organici e generati attraverso algoritmi sofisticati per produrre migliaia di calcoli a ogni ricerca in una frazione di secondo, basandosi solo sulla rilevanza di una pagina per l’utente”.

E quindi, “Google non accetta mai pagamenti da nessuno per essere nei risultati della ricerca organica o alterare il posizionamento di una pagina in qualsiasi modo”, si spiega nel video, forse anche come risposta all’ormai noto attacco del Wall Street Journal.

Diverso è il caso degli annunci ADS in SERP, pubblicità che comprare tra i risultati della ricerca ma che “sono segnalate ed etichettate chiaramente, quindi è facile distinguerle dal resto della pagina”, dicono da Mountain View (ma forse il messaggio non è chiaro per tutti, come si diceva nei giorni passati!).

Un processo che si completa in pochi secondi

Quindi, in definitiva: Google esplora il web per scoprire nuovi contenuti, indicizza i contenuti categorizzandoli come in un catalogo e i suoi sistemi di ranking analizzano l’indice per mostrare i risultati più rilevanti agli utenti. Poi interviene la SEO per cercare di migliorare il posizionamento su Google in ottica strategica e di business!