A/B Test: cos’è e come usarlo per migliorare SEO e conversioni

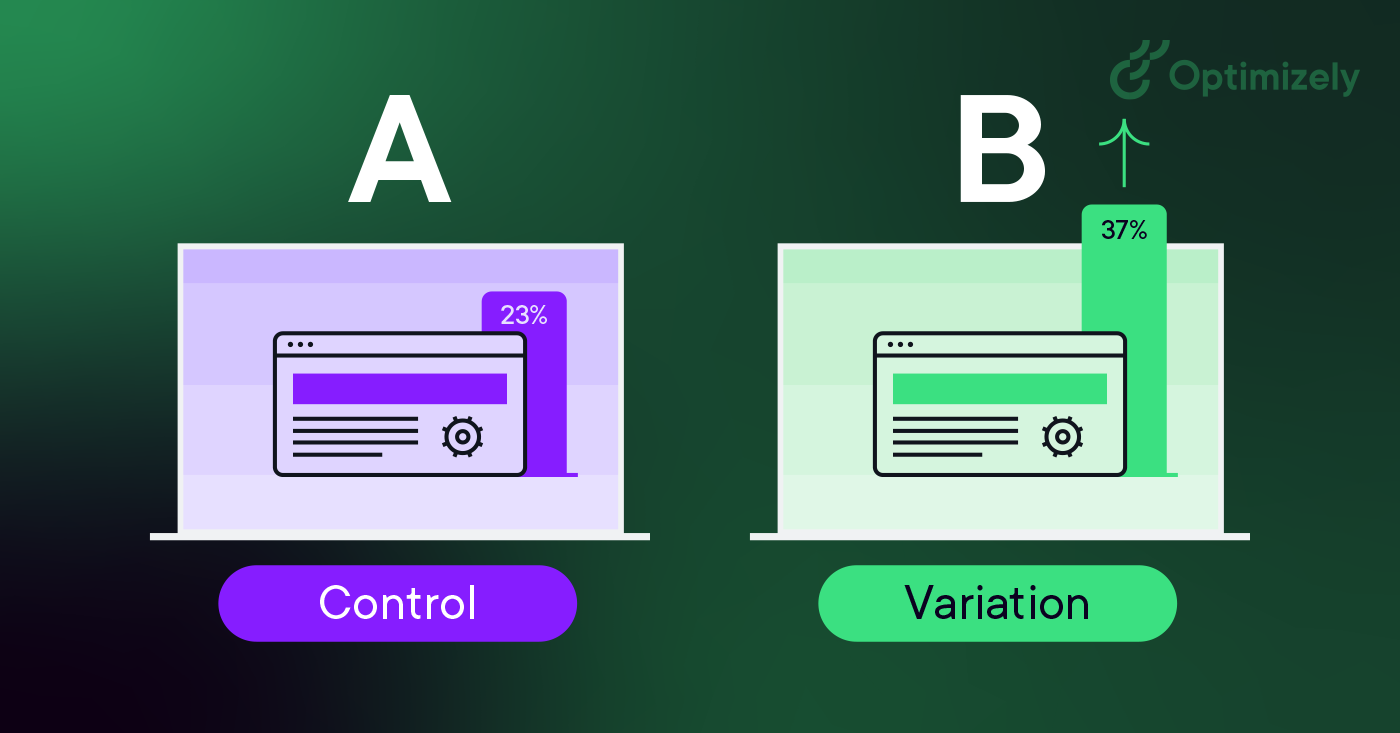

È un esperimento controllato che mette a confronto e alla prova due varianti di una stessa pagina web, chiamate A e B, che sono quasi identiche a parte una differenza chiave, come un titolo, la call-to-action, il colore di un pulsante o la struttura di un menu. Grazie all’analisi diretta della reazione degli utenti di fronte alle versione a cui hanno avuto accesso, possiamo studiare e comprendere cosa funzioni meglio rispetto alle metriche e agli obiettivi che abbiamo prefissato, in modo da prendere decisioni informate e basate sui dati su quali modifiche migliorano le conversioni o l’engagement. È per questo che l’A/B test o test A/B è uno dei sistemi più utilizzati per verificare l’efficacia degli interventi e dei cambiamenti apportati sul sito, utile soprattutto per verificare l’effettivo gradimento degli utenti posti dinanzi a due opzioni differenti per stile, grafica e contenuti. Scopriamo qualcosa in più sul Test A/B e impariamo a impostarlo nel modo migliore per il nostro sito, imparando anche come ridurre al minimo l’impatto dell’attività di testing nella Ricerca Google seguendo i suggerimenti ufficiali del motore di ricerca.

Che cos’è l’A/B test

Chiamato anche bucket test o split test, il test A/B è un esperimento controllato con due varianti – denominate appunto A e B – che prevede lo sviluppo di due versioni della stessa pagina diverse per una singola variabile, da sottoporre contemporaneamente a un campione di utenti, così da avere dati concreti su quale superi l’altra nel gradimento e nelle interazioni dei visitatori.

L’A/B test è quindi una metodologia di testing comparativo che serve a ottimizzare le pagine web e le strategie di marketing digitale perché consente di ottenere dati informati per comprendere le preferenze degli utenti e per migliorare l’efficacia di un contenuto o di una campagna, analizzando la risposta del soggetto (un campione dell’audience tipo) rispetto alla variabile A o B per determinare in questo modo quale risulti la più efficace in base a metriche specifiche.

Questo processo è fondamentale perché può influenzare direttamente il tasso di conversione, il coinvolgimento dell’utente e, in ultima analisi, il successo di un sito web o di un prodotto digitale.

A cosa serve il testing A/B e che obiettivi ha

Molto usato nel web analytics e risorsa strategica per creare una landing page perfetta, questo strumento rientra tra i test di verifica d’ipotesi o “test di ipotesi a 2 campioni” nel campo della statistica.

È buona prassi fare ricorso all’A/B testing quando miriamo alla massimizzazione della performance e quando desideriamo prendere decisioni informate su elementi critici delle nostre campagne digitali. Situazioni comuni possono essere il momento di introduzione di nuove funzionalità, l’ottimizzazione delle pagine di destinazione o il miglioramento delle campagne di direct email marketing. Inoltre, l’A/B testing diventa essenziale quando abbiamo due teorie differenti su un approccio di marketing e desideriamo convalidare l’opzione migliore prima di un rollout completo.

L’obiettivo dell’attività è molto semplice quanto strategico: identificare i cambiamenti – anche apparentemente piccoli – all’interno di una pagina web che incrementano o massimizzano il risultato di un interesse, come ad esempio il click-through rate per un banner pubblicitario, e per questo è decisivo nel Web design e nello studio della user experience.

In concreto, l’A/B testing si rivela utile in diverse circostanze: ad esempio, può essere impiegato quando vogliamo aumentare il tasso di conversione di una landing page o quando desideriamo testare l’efficacia di una call-to-action, ma è efficace anche per valutare l’impatto di piccole modifiche al design o al contenuto di una pagina, come le variazioni titoli, immagini o descrizioni di prodotto. Ciò vale anche in ambito SEO, dove le varianti ci aiutano a capire se interventi mirati su titoli, meta descrizioni o sull’organizzazione dei contenuti possano influenzare il comportamento degli utenti e, di conseguenza, il ranking nei motori di ricerca.

I vantaggi dell’A/B testing

Già da quanto scritto si intuisce che il test A/B è uno strumento di ottimizzazione potente e flessibile che, utilizzato correttamente, può fornire insight preziosi e guidare decisioni basate su dati concreti, migliorando l’esperienza utente e la performance complessiva di un sito web anche nel contesto SEO.

Pensiamo a una landing page e a un aspetto apparentemente insignificante come il colore del pulsante di call-to-action: meglio rosso o verde? Con un A/B test possiamo creare due versioni, in modo che un gruppo di utenti vedrà il rosso e l’altro il verde, per poi rispondere a domande del tipo “Quale favorisce più click? Quale porta più vendite?”.

L’aspetto chiave è “decisioni informate”: nell’attuale contesto iper-competitivo, ignorare i dati raccolti sarebbe come navigare senza bussola o affidandosi al caso e alle supposizioni. Le intuizioni possono essere utili, ma i dati non mentono. Il test A/B ci permette di affilare la nostra strategia digitale, di scolpire la user experience fino allo stato più puro, quello in cui ogni elemento è ottimizzato per i nostri obiettivi.

Anche una piccola modifica può significare un notevole incremento nel tasso di conversione, nel coinvolgimento dell’utente e quindi nel rendimento economico.

Non dimentichiamo poi che i comportamenti degli utenti evolvono e il mercato muta con rapidità vertiginosa: il test A/B non è un singolo esperimento ma un approccio continuo, un dialogo costante con il proprio target. È l’essenza stessa dell’adattabilità: il messaggio che funziona oggi potrebbe non essere efficace domani, e ciò che risona con un segmento di utenti potrebbe essere inefficace con un altro.

Sfruttare i test per il CRO

Scendendo più nel dettaglio, se implementato in modo corretto il test ci permette di sperimentare singoli elementi del sito che intendiamo variare e determinare se le modifiche sono efficaci per il nostro pubblico: la funzione più pratica e diffusa è proprio l’analisi delle call to action, elementi che devono essere realizzati in maniera più che studiata per produrre risultati.

La mancata efficacia delle call to action può dipendere da varie ragioni, tra cui i cambiamenti nel comportamento degli utenti, spostamenti nell’audience o il modo generale in cui gli utenti interagiscono con il nostro sito Web.

Fare piccole modifiche e testarle è un processo critico, che rientra nelle operazioni di CRO (conversion rate optimization, ottimizzazione del tasso di conversione) e implica l’uso di test scientificamente validi sugli elementi di interazione dell’utente sul nostro sito, con l’obiettivo di ottenere un aumento significativo delle prestazioni al termine di tutte le prove.

Come fare un test A/B efficace

Per effettuare un test A/B con successo è fondamentale rispettare alcuni passaggi chiave. Inizialmente, definiamo l’obiettivo del test: ad esempio, aumentare il tasso di clic su un pulsante, incrementare il tempo di permanenza sulla pagina o un altro dei KPI, gli indicatori di performance. Successivamente, identifichiamo l’elemento da testare e creiamo due versioni: la versione A, che di solito corrisponde al design attuale (il controllo), e la versione B con la variazione che vogliamo testare. Poi, dividiamo in maniera casuale il nostro pubblico in due gruppi, in modo che ognuno visualizzi soltanto una delle due versioni. Questo processo deve essere supportato da strumenti di analisi che raccolgano dati sul comportamento degli utenti per ogni versione della pagina. Una volta completato il test e raccolto dati sufficienti, analizziamo i risultati per determinare quale delle due versioni ha generato le migliori performance secondo le metriche stabilite.

È fondamentale che il test A/B sia condotto in modo controllato e che le variabili siano limitate al minimo per garantire che i risultati siano attribuibili alle modifiche apportate. Inoltre, è importante che il test si svolga per un periodo di tempo adeguato, in modo da raccogliere un campione di dati rappresentativo e ridurre l’impatto di anomalie o eventi esterni.

Attraverso l’uso del test A/B possiamo quindi attuare cambiamenti basati su fatti concreti e non su supposizioni: questa metodologia di lavoro ci permette di affinare le nostre strategie digitali e di personalizzarle in base alle esigenze e alle preferenze del nostro target, un passo essenziale nella costruzione di esperienze utente soddisfacenti e campagne marketing digitale che portino più risultati.

I passaggi per creare un A/B test

La creazione di un test A/B di successo comporta una ricerca su più fronti, a cominciare dalla dimensione e lo stato attuale del sito web

In molti casi, se abbiamo siti piccoli o con un pubblico ristretto, non è necessario fare questo tipo di esperimenti, ma anche se già conosciamo le best practices più diffuse per il nostro settore tale test può comunque segnalare quali sono le modifiche utili da apportare. Piuttosto che lanciarsi in questa operazione, un sito piccolo avrebbe migliori risultati (e con minor sforzo) intervistando i propri clienti, scoprendo i punti deboli e lavorando sull’ottimizzazione del sito in base ai feedback ricevuti.

Diverso è il caso dei siti di grandi dimensioni (oltre 10.000 visitatori al mese e con centinaia di pagine, dice l’articolo), perché eseguire i test A/B può aiutarci a scoprire quale versione darà la migliore conversione tra quelle del campione. Tale attività diventa indispensabile per siti ancora più grandi, dove anche un solo, singolo elemento può determinare un grande ritorno in conversioni.

Ciò che dobbiamo fare è stabilire una linea di base generale del traffico del sito, che ci permette di proseguire con la valutazione degli elementi del sito Web e di ciò che dobbiamo cambiare per eseguire un test efficace.

Decidere quali elementi testare

Siamo arrivati a una fase decisiva, ovvero decidere quali elementi variare e sottoporre al test, un passaggio che richiede a sua volta prove (e spesso) errori per ottenere il risultato giusto.

Ad esempio, se riteniamo che per il nostro settore una CTA di colore rosso sia vista meglio rispetto al blu che stiamo usando, cambieremo il colore dei pulsanti durante il test A/B e scopriremo dalle reazioni degli utenti quale converte meglio realmente. L’utilità del test A/B è che permette di scoprire a cosa rispondono realmente i nostri utenti, piuttosto che modificare il sito in base a semplici ipotesi.

Questa è una distinzione importante da fare, perché spesso il lavoro di ottimizzazione del sito si basa su supposizioni (per quanto realistiche o studiate), e a meno di non aver parlato direttamente con i clienti non sappiamo a cosa stanno rispondendo. Invece il test A/B trasforma la teoria in uno strumento di alta precisione: dopo un test riuscito, sapremo cosa funziona meglio per i nostri utenti.

I test di usabilità

Il test utente è la fase più essenziale del test di usabilità, che rappresenta a sua volta uno strumento cruciale nella valutazione dell’usabilità del sito. In realtà, lo studio sugli utenti e sull’audience dovrebbe essere sempre inserito in un processo continuo, anziché essere condotto a casaccio.

Lo scopo di questo test è comprendere in modo più sistematico come le persone comunicano con il nostro sito, e il test di usabilità ci permette di riconoscere se ci sono eventuali difficoltà riscontrate nel funnel di conversione degli utenti. Il secondo step è avviare una procedura di screening per l’analisi degli utenti, che possono avere molti obiettivi o un solo obiettivo.

Ad esempio, lo screening degli utenti può essere progettato per:

- Scoprire come gli utenti eseguono realmente la scansione della pagina.

- Valutare cosa sta realmente attirando la loro attenzione.

- Risolvere eventuali carenze nei contenuti esistenti.

- Scoprire quali sono i punti deboli dei pulsanti e come correggerli.

Gli esempi di test A/B sul contenuto

Come abbiamo detto in precedenza, i contenuti sono uno dei possibili oggetto di test, soprattutto se non siamo sicuri su quale sia la tipologia e la forma che possa aver maggior presa sul nostro pubblico.

Ad esempio, se i lettori sono abituati a un testo più lungo e sono propensi a un’interazione quando lo trovano – come nel caso di molti studiosi e persone in settori accademici – il nostro obiettivo è realizzare un testo che appaia come un saggio. Se però l’audience è composta da lettori più informali, sarebbe meglio usare righe di testo e paragrafi più brevi.

E quindi, possiamo fare un test realizzando due pagine – una con contenuto lungo e formale, l’altra con testo breve e più accattivante – per scoprire quale offra migliori risultati.

Oppure, possiamo studiare l’effetto di modifiche sulla dimensione del font, sul colore o sulla spaziatura, per scoprire se tali fattori influenzano la leggibilità ed, eventualmente, anche la comprensione e il gradimento del contenuto.

Esempi di split test sui pulsanti

Le prove possono riguardare anche dettagli all’apparenza minori, come le dimensioni del pulsante della CTA: se gli utenti che cliccano sul pulsante sono minori rispetto ai desideri, o se le persone compilano il modulo inserendo informazioni sbagliate, è possibile intervenire per capire dove sia il problema e testare elementi distinti del form, incluso il pulsante.

Ad esempio, possiamo migliorare il testo scritto del modulo per ottenere conversioni migliori e più accurate; molti esperti di questo processo raccomandano di fornire agli utenti una scadenza per una richiesta, con un messaggio che segnala all’utente “Risponderemo al tuo messaggio entro 24 – 48 ore”, un intervento noto come “impostazione delle aspettative dell’utente”.

Una piccola soluzione di questo tipo sviluppa anche la fiducia, perché dice alle persone che riceveranno una risposta garantita (ovviamente da rispettare) senza temere che la loro richiesta finisca in un dimenticatoio.

Variare la comunicazione del brand

Il modo in cui comunichiamo è importante tanto quanto il contenuto che viene interpretato dal pubblico, ricorda Brian Harnish da Search Engine Journal, e non “puoi sapere esattamente a cosa risponderà il tuo pubblico senza testare le variabili live” e non è possibile sapere in anticipo “cosa susciterà la reazione che desideri”.

Ecco perché è importante “testare variabili in tempo reale e varianti di queste variabili”.

Uno dei test più importanti comporta la modifica del messaggio, in particolare di titoli, frasi nei contenuti, tagline e formulazione delle call to action, perché la comunicazione potrebbe non essere efficace come vogliamo (e pensiamo).

Gli split test possono rivelare cose sui nostri utenti che potremmo non aver mai sospettato e sono, come detto, uno strumento molto utile per capire se, come e quando apportare modifiche al sito che possano dare miglioramenti concreti (anche in termini di redditività).

La chiave per il successo di tali test è creare una solida metodologia: dopo aver pianificato e messo a punto gli elementi finali, dobbiamo eseguirli e, soprattutto, verificare nel tempo dato la risposta degli utenti. Solo così possiamo essere (più) sicuri di apportare interventi che funzioneranno e daranno i risultati sperati.

Non affidarsi al caso per le modifiche al sito: impostare prima gli obiettivi

È abbastanza scontato dire che le modifiche sul sito non devono essere apportate in modo casuale, intervenendo in modo non strategico sui singoli elementi e sperando per il meglio. Così facendo riduciamo le possibilità di avere risultati concreti e misurabili, perché non sappiamo a cosa attribuire i possibili effetti riscontrati.

Soprattutto per siti grandi in settori molto complessi, non è possibile trarre conclusioni opportune su cosa cambiare e cosa non cambiare all’interno delle pagine se non conosciamo il modo in cui gli utenti target interagiscono con il sito Web, ed è qui che entra in gioco il test A/B.

Le conversioni non avvengono e basta e per ottenere risultati reali – ad esempio, persone vere che acquistano il nostro servizio o prodotto – è necessario un significativo investimento di tempo, per studiare il rendimento degli utenti sul sito e apportare modifiche apposite per stimolare le loro azioni.

La brutale realtà del marketing digitale è questa, dice ancora Harnish: dobbiamo “sapere cosa dicono i dati relativi alle modifiche prima di poter apportare le modifiche”. L’intera ragion d’essere di tali test è permetterci di avere dei risultati concreti sulle modifiche prima di apportarle, consolidare le ipotesi sulle ottimizzazioni in un set di dati reali.

Se un super-esperto di marketing saprà quali modifiche apportare in base alla propria esperienza e quindi potrà ridurre il tempo necessario per i test e le analisi che migliorano le prestazioni di un sito Web, un marketer meno esperto farà test casuali che non sempre raggiungono il risultato desiderato.

Un esempio concreto: il test per migliorare le campagne di affiliazione

L’articolo fornisce anche un esempio per capire il funzionamento dello split test, analizzando uno dei modi “per guadagnare soldi su Internet oggi”, ovvero l’affiliate marketing, che si può fare offrendo “ai clienti un prodotto o un servizio gratuito fornito come affiliato” che fa guadagnare una commissione per ogni vendita.

Se otteniamo sufficienti informazioni sui nostri clienti possiamo costruire una relazione con loro, perché realizziamo un rapporto di fiducia; questo processo di studio ci permette di imparare anche molto sul modo in cui usano il sito web e di implementare modifiche che possono aiutare gli utenti a raggiungere ciò che stanno cercando di ottenere, ovvero acquistare il nostro servizio o prodotto.

Quali elementi verificare nell’A/B test

Harnish segnala anche quali sono gli elementi che possono avere il massimo potenziale di ritorno sul ROI durante il test, che includono tra gli altri:

- Tutte le CTA del sito.

- Il colore di sfondo complessivo del sito.

- I colori degli elementi dell’intera pagina.

- La fotografia delle pagine.

- Contenuti e loro struttura.

- Qualsiasi elemento sulla pagina che richiede l’interazione dell’utente.

Gli elementi del sito sono adattamenti critici che possono comportare aumenti significativi delle prestazioni: ad esempio, se pensiamo che un pulsante di conversione non funzioni correttamente, possiamo sottoporre una variante (colore diverso, o testo modificato) a un campione degli utenti reali del sito, che possono fornirci una prova fattuale sull’efficacia della nuova soluzione.

Con il test A/B possiamo verificare le prestazioni di un elemento alla volta, variandolo e paragonandolo a una versione alternativa che contiene modifiche studiate sul comportamento ipotizzato degli utenti.

In realtà, gli elementi che possiamo verificare possono variare ampiamente a seconda degli obiettivi specifici e del contesto in cui operiamo, anche se solitamente si preferisce lavorare su un set di aspetti, quelli che effettivamente hanno il potenziale di influenzare in modo significativo il comportamento degli utenti e le performance del sito, come ad esempio:

- Titoli delle Pagine.I titoli sono fondamentali per catturare l’attenzione degli utenti e per il ranking nei motori di ricerca: testare variazioni di titoli può rivelare quale formula attira di più e coinvolge il pubblico target.

- Meta Descrizioni.Anche se le meta description non influenzano direttamente il ranking SEO, possono influenzare il CTR dai risultati di ricerca: testare diverse descrizioni può aiutare a capire quali sono più efficaci nel persuadere gli utenti a cliccare.

- Call-to-Action (CTA).Le CTA guidano gli utenti verso azioni specifiche, come l’iscrizione a una newsletter o l’acquisto di un prodotto: variazioni nel testo, nel colore o nella posizione delle CTA possono avere un impatto significativo sulle conversioni.

- Immagini e Video.Gli elementi visivi possono influenzare l’engagement e la conversione: testare diverse immagini o video può determinare quali sono più efficaci nel comunicare il messaggio desiderato.

- Layout e Struttura della Pagina. La disposizione degli elementi su una pagina può influenzare l’usabilità e l’esperienza utente; modificare la struttura può portare a miglioramenti nella navigazione e nel tempo di permanenza sulla pagina.

- Contenuto del Testo. La chiarezza, la persuasività e la lunghezza dei testi possono influenzare il modo in cui gli utenti interagiscono con una pagina; testare diversi approcci di scrittura può aiutare a trovare il tono e lo stile più adatti al pubblico.

- Form di Contatto o di Iscrizione. La semplicità o la complessità di un form può influenzare il numero di conversioni; testare variazioni nel numero di campi o nel design può ottimizzare il processo di raccolta dati.

- Elementi di Navigazione. La facilità con cui gli utenti possono navigare e trovare informazioni su un sito è cruciale. Testare diversi menu o schemi di navigazione può migliorare l’esperienza utente e ridurre il tasso di abbandono.

- Velocità di Caricamento. Anche se non direttamente testabile con un A/B test tradizionale, la velocità di caricamento è un fattore critico per l’esperienza utente e la SEO; si possono testare variazioni nella compressione delle immagini o nell’ottimizzazione del codice per migliorare i tempi di caricamento.

- Elementi di validazione sociale.Recensioni, testimonianze e casi studio possono aumentare la fiducia e influenzare la decisione di acquisto; testare la loro posizione o il modo in cui vengono presentati può avere un impatto sulle conversioni.

È importante notare che, mentre lavoriamo per verificare l’efficacia di questi elementi attraverso l’A/B testing, dobbiamo mantenere una visione olistica dell’esperienza utente e del percorso di conversione, assicurandoci che le modifiche apportate siano coerenti con il brand e il messaggio complessivo del sito. Inoltre, ogni test deve essere condotto in modo sistematico, assicurandoci di raccogliere dati sufficienti per fare analisi statisticamente significative prima di apportare cambiamenti permanenti.

Quali strumenti usare per monitorare i risultati

La fase conclusiva e più importante dell’attività di testing è la verifica dei risultati, che necessita ovviamente di strumenti e metodi che possano tracciare accuratamente le prestazioni delle diverse varianti e fornire dati affidabili per l’analisi.

In genere, possiamo fare affidamento su:

- Strumenti di analisi web, come Google Analytics, per monitorare il traffico web e analizzare il comportamento degli utenti, segmentando i dati per variante di test e monitorando metriche chiave come il tasso di conversione, il tempo di permanenza sulla pagina e il tasso di rimbalzo.

- A/B testing tool, come Optimizely, progettati appositamente per offrire funzionalità di test A/B, multivariato e personalizzazione, integrando analisi in tempo reale; consentono di eseguire i test A/B e aiutano a definire i parametri che potremmo decidere di variare.

- Strumenti per heatmap e registrazione sessioni, come Hotjar, con cui studiare come gli utenti interagiscono con le diverse varianti di una pagina.

- Metodi Statistici, come ad esempio i test di significatività statistica (come il test t di Student o il test chi-quadrato) che aiutano a stabilire se le differenze osservate tra le varianti sono dovute al caso o se riflettono una vera differenza di performance. Inoltre, calcolare l’intervallo di confidenza per le metriche chiave può fornire una stima dell’intervallo entro il quale ci si può aspettare che i veri valori delle metriche si trovino, considerando un certo livello di confidenza (ad esempio, il 95%).

- Strumenti di Analisi del Traffico organico, come SEOZoom o altri SEO tool.

Un approccio diverso agli interventi sul sito

Il consiglio finale che arriva da Harnish è affrontare i test A/B con una mentalità aperta, senza pregiudizi sugli elementi da sottoporre a verifica e sugli eventuali risultati, perché in questo modo possiamo scoprire davvero ciò che non conosciamo.

Ad esempio, possiamo eseguire un test su come il sito mostra i contatti (come il numero di telefono), utilizzando elementi distinti all’interno dello stesso segmento del campione di data audience per determinare quali ottengono i risultati migliori. Oppure possiamo eseguire un test del contenuto, per assicurarci in maniera rapida di non perdere tempo e sforzi su contenuti che semplicemente non funzioneranno.

Questo approccio ci permette di avere una dimostrazione reale ed empirica di quanto bene funzioni il sito in ogni singolo elemento, e in alcuni casi possiamo ottenere risultati davvero eccellenti sulle conversioni finali semplicemente implementando una variazione che migliora qualcosa che prima non funzionava.

Il rapporto tra test A/B e SEO: vantaggi e rischi

Tra A/B test e SEO c’è una relazione delicata, perché l’esecuzione dell’attività di testing può esporci a rischi e danni alla visibilità organica, che principalmente da potenziali conflitti con le linee guida dei motori di ricerca e dall’impatto che le modifiche possono avere sull’esperienza utente e sulla percezione del sito da parte dei motori di ricerca – in particolare, si ricordano casi di possibili effetti negativi che la conduzione di un test delle variazioni nel contenuto della pagina o negli URL delle pagine può provocare sul rendimento nella Ricerca Google.

Se però lavoriamo in modo efficace e corretto, il test A/B diventa uno strumento prezioso perché consente di applicare modifiche informate alle nostre pagine, superando uno dei grandi limiti della SEO: non essendo una scienza esatta, ciò che funziona per un sito potrebbe non funzionare per un altro. Facendo sperimentazioni “sul campo”, invece, potremmo verificare che una semplice modifica a un titolo può aumentare il CTR, indicando ai motori di ricerca che quella pagina è particolarmente rilevante per determinate query e generando un circolo virtuoso di maggiore visibilità e traffico.

Un altro aspetto da non trascurare è il fattore tempo: alla SEO serve tempo per “portare risultati”, e anche la verifica dei test può richiedere periodi più lunghi rispetto ad altri canali digitali, poiché i motori di ricerca possono essere “lenti” nell’indicizzare e valutare i cambiamenti. Questo significa che dobbiamo essere pazienti e attendere che i dati si accumulino prima di trarre conclusioni definitive.

SEO e A/B test: le indicazioni di Google

Insomma, il test A/B in ambito SEO deve essere gestito con cura e non è un caso che Google stesso abbia fornito delle specifiche indicazioni su come condurre esperimenti delle varianti di contenuti o URL delle pagine senza incorrere in penalizzazioni o danneggiamenti di ranking.

Comparsa online nel settembre 2022 e aggiornata l’ultima volta a fine novembre 2023, questa guida ci mette in guardia contro i principali problemi e suggerisce le soluzioni per minimizzare i rischi degli A/B test sulla SEO.

Il documento chiarisce innanzitutto cosa si intende per test dei siti, ovvero “una prova di diverse versioni di un sito web (o di una sua parte), combinata con la raccolta di dati relativi alle reazioni degli utenti nei confronti di ciascuna versione”. In questa definizione rientrano, pertanto, due tipologie di test:

- Il test A/B che, come detto, consiste nel testare due (o più) varianti di una modifica. Ad esempio, possiamo provare diversi tipi di carattere per un pulsante per vedere se così aumentano i clic.

- Il test multivariato, che invece prevede di testare più di un tipo di modifica alla volta, cercando l’impatto di ciascun intervento e le potenziali sinergie tra le modifiche. Ad esempio, potremmo provare diversi tipi di carattere per un pulsante, ma anche provare a cambiare in contemporanea quello del resto della pagina (rendendo identico a quello del pulsante): il nuovo font è più facile da leggere e quindi dovrebbe essere usato ovunque, oppure l’uso di un font diverso sul pulsante rispetto al resto della pagina aiuta ad attirare l’attenzione?

Google ci ricorda che possiamo utilizzare un software per confrontare il comportamento con diverse varianti delle pagine (parti di una pagina, pagine intere o interi flussi di più pagine) e monitorare quale versione è più efficace con i nostri utenti. Inoltre, possiamo fare test creando più versioni di una pagina, ognuna con il proprio URL: quando gli utenti tentano di accedere all’URL originale, ne reindirizziamo alcuni a ognuna delle singole varianti e quindi confrontiamo il comportamento degli utenti per vedere quale pagina sia più efficace.

Ancora, possiamo eseguire test senza modificare l’URL inserendo variazioni in modo dinamico nella pagina, usando anche JavaScript per decidere quale variante mostrare.

Test sui siti e Google, gli aspetti da considerare

A seconda dei tipi di contenuti che stiamo testando, dice la guida, potrebbe non essere nemmeno “molto rilevante se Google esegua la scansione o l’indicizzazione di alcune delle variazioni dei contenuti nel corso dell’attività di testing”. Piccole modifiche, come le dimensioni, il colore o la posizione di un pulsante o di un’immagine, o il testo della call to action possono avere un impatto sorprendente sulle interazioni degli utenti con la pagina, ma “spesso hanno un impatto minimo o nullo sullo snippet o sul posizionamento nei risultati di ricerca di quella pagina”.

Inoltre, se Googlebot esegue la scansione del sito “abbastanza spesso da rilevare e indicizzare l’esperimento”, probabilmente indicizzerà gli eventuali aggiornamenti definitivi che apportiamo in modo piuttosto rapido a conclusione del test.

Le best practices di Google per il testing dei siti

Il documento entra anche in dettagli più tecnici e pratici, fornendo una serie di best practices da seguire per evitare spiacevoli effetti negativi sul comportamento del sito nella Ricerca Google durante il test delle varianti.

- Non fare cloaking delle pagine di prova

Non mostrare un insieme di URL a Googlebot e un insieme diverso agli esseri umani, e quindi “non fare cloaking”, una tattica black hat che viola le Istruzioni di Google, indipendentemente dal fatto che stiamo eseguendo un test o meno. Il rischio di queste violazioni è “far retrocedere o rimuovere il sito dai risultati di ricerca di Google”, non esattamente il risultato che ci auspichiamo.

Il cloaking conta sempre – sia se lo eseguiamo tramite server logic che attraverso robots.txt o qualsiasi altro metodo – e in alternativa Google suggerisce di usare link o reindirizzamenti come descritto di seguito.

Se usiamo i cookie per controllare il test, dobbiamo tener presente che Googlebot generalmente non supporta i cookie: quindi, vedrà solo la versione del contenuto accessibile agli utenti con browser che non accettano i cookie.

- Usare link rel=”canonical”

Se stiamo facendo un test con più URL, possiamo utilizzare l’attributo rel=”canonical” su tutti gli URL alternativi per indicare che l’URL originale è la versione preferita. Google consiglia di utilizzare rel=”canonical” piuttosto che un meta tag noindex perché “corrisponde più strettamente alle intenzioni in questa situazione”. Ad esempio, se stiamo testando varianti della home page, non vogliamo “che i motori di ricerca non indicizzino la home page, ma solo che capiscano che tutti gli URL di test sono duplicati o varianti simili all’URL originale e dovrebbero essere raggruppati insieme, con l’URL originale come canonico”. L’uso di noindex anziché del canonical in una situazione del genere a volte potrebbe avere effetti negativi inaspettati.

- Usare redirect 302 e non redirect 301

Se stiamo eseguendo un test che reindirizza gli utenti dall’URL originale a un URL variante, Google ci invita a usare un redirect 302 (temporaneo) e non un redirect 301 (permanente). Questo dice ai motori di ricerca che il reindirizzamento è temporaneo (sarà attivo solo finché l’esperimento è in corso), appunto, e che dovrebbero mantenere l’URL originale nel loro indice, piuttosto che sostituirlo con l’URL destinazione del reindirizzamento (il test pagina). Vanno bene anche i reindirizzamenti basati su JavaScript.

- Lanciare l’esperimento solo per il tempo necessario

La quantità di tempo necessaria per un test affidabile varia in base a fattori come i tassi di conversione e la quantità di traffico che riceve il sito web, e un buon strumento di test ci dice quando abbiamo raccolto abbastanza dati per trarre una conclusione affidabile. Una volta terminato il test, dobbiamo aggiornare il sito con le varianti di contenuto desiderate e rimuovere il prima possibile tutti gli elementi del test, come URL alternativi o script di test e markup. Se Google scopre “un sito che esegue un esperimento per un tempo inutilmente lungo” potrebbe interpretarlo come un tentativo di ingannare i motori di ricerca e agire di conseguenza, soprattutto se il sito propone una variante di contenuto a un’ampia percentuale dei suoi utenti.