Sempre più AI nella Ricerca: i principali annunci di Google Search On 2021

Il futuro di Google e delle ricerche online sarà sempre più tecnologico: se già a Google I/O 2021 avevamo avuto un antipasto delle ultime applicazioni di Intelligenza Artificiale per il sistema della Ricerca, con l’appuntamento Search On 2021 il gruppo di Mountain View è andato ancora più in profondità, svelando in che modo l’AI aiuterà gli utenti che utilizzano il motore di ricerca, perfezionando la sua capacità di comprendere le esigenze e formulare risposte, ma non solo.

Google riprogetta l’algoritmo di ricerca con MUM

L’annuncio che ha maggiormente destato l’attenzione – e che riguarda più o meno direttamente anche noi che operiamo nel settore SEO e search marketing – riguarda la riprogettazione di Ricerca Google che è in corso grazie a MUM – Multitask Unified Model, il potente algoritmo presentato nei mesi passati e che sta dando prova di grande efficienza, offrendo un modo intuitivo per esplorare argomenti e far emergere più contenuti nelle SERP.

In termini più concreti, le applicazioni di Intelligenza Artificiale consentono a Google di ampliare il vecchio modo di cercare le risposte e di introdurre un modo più intuitivo per esplorare gli argomenti, offrendo un’esperienza di ricerca ridisegnata e molto più visiva, che guiderà gli utenti lungo i percorsi degli argomenti.

MUM e la ricerca multimodale

Sin dalla presentazione di MUM, Google aveva evidenziato l’elemento realmente distintivo di questa tecnologia, ovvero la multimodalità applicata alla comprensione delle informazioni e delle richieste degli utenti che lanciano una query.

Nella prima sperimentazione resa pubblica, MUM aveva correttamente identificato e in pochi secondi 800 variazioni dei nomi dei vaccini contro il Covid in 50 lingue differenti, dimostrando la sua capacità nella gestione del testo. Questa tecnologia, infatti, esamina e interpreta le parole della query non nel classico modo sequenziale delle macchine (da sinistra verso destra o viceversa, a seconda della lingua), ma in modo simile alla comprensione umana, saltando “tra le parole per capire meglio e prima il significato dell’intera frase (…), applicando a ogni passo un meccanismo di auto-attenzione che modella direttamente le relazioni tra tutte le parole in una frase, indipendentemente dalla loro rispettiva posizione” (DDay).

Funzioni innovative e futuristiche, che però non racchiudono tutte le potenzialità di MUM e non raccontano le sue capacità multimodali: la tecnologia, infatti, va oltre alla comprensione testuale e può anche gestire immagini e video, facendo dei “salti” anche tra mezzi di comunicazione e strumenti diversi.

Esempi di applicazioni di MUM nella Ricerca

Gli utenti al momento sono abituati a cercare risposte, ma grazie alle nuove evoluzioni della Ricerca Google potranno cercare in modi diversi ed esplorare attività più complesse, sfruttando anche mezzi diversi come le immagini per raggiungere ciò che serve loro.

È Prabhakar Raghavan, senior Vice President della compagnia statunitense, a fornire alcuni esempi di come cambia la Ricerca Google grazie a MUM, soprattutto per la navigazione mobile.

Innanzitutto, con questa nuova funzionalità integrata con Lens possiamo toccare l’icona dell’obiettivo mentre visualizziamo l’immagine di una maglietta e “chiedere a Google di trovare lo stesso stile, ma su un altro capo di abbigliamento, come i calzini”. Questo ci aiuta quando stiamo cercando qualcosa che potrebbe essere difficile da descrivere con precisione con le sole parole – restando all’esempio che vediamo in pagina, potremmo digitare “calzini fiori vittoriani bianchi”, ma potremmo non trovare il modello esatto che ci interessa. Invece, “combinando immagini e testo in un’unica query semplifichiamo la ricerca visiva e l’espressione delle domande in modi più naturali”.

Un’altra applicazione è la modalità di ricerca “punta e chiedi” (point-and-ask), che rende più facile soddisfare un’esigenza specifica: ad esempio, se si è rotto un componente specifico della bici (di cui non conosciamo esattamente il nome) e ci serve una guida per riparare quel pezzo, anziché esaminare in dettaglio tutti i cataloghi delle parti e poi cercare un tutorial, possiamo inquadrare con Lens l’elemento danneggiato e lanciare la query “come aggiustare”, che Google comprenderà.

Stando alle anticipazioni, questa funzione sarà disponibile in un primo momento su YouTube e poi estesa anche ad altre piattaforme video; Liz Reid, vicepresidente del reparto Search, ha spiegato a ItalianTech che “MUM non ricava le informazioni dai contenuti dei singoli frame di un video, ma da trascrizioni dell’audio generate automaticamente usando il riconoscimento della voce”.

Sistemi innovativi per perfezionare le ricerche

La riprogettazione del motore di ricerca con MUM e i progressi dell’IA va ancora oltre e si allontana enormemente dalle vecchie SERP con i 10 link blu, perché Google sta per lanciare una serie di nuove funzioni in Google Search, che serviranno a orientare le ricerche per offrire risposte più rapide e più precise e rendere il sistema più naturale e intuitivo. Si chiamano:

- Things to know – Cose da sapere.

- Broaden/ Refine – Ingrandimento o restringimento dell’argomento.

- Risultati di ricerca sfogliabili visivamente.

Things to know è in arrivo nei prossimi mesi e serve a semplificare l’esplorazione e la comprensione di nuovi argomenti, elencando vari aspetti del topic cercato dall’utente e permettendo agli utenti di vedere altri aspetti che le altre persone in genere cercano, aiutandoli a ottenere più velocemente le informazioni che stanno cercando e orientando il percorso verso l’obiettivo.

Ad esempio, se vogliamo decorare le pareti di casa e siamo interessati a saperne di più sulla pittura acrilica, all’interno della SERP per questa query troveremo la nuova feature, che elenca varie angolazioni dell’argomento come “passo dopo passo”, “stili” e “utilizzo di articoli per la casa”, mettendo in evidenza quelli che più probabilmente le persone guardano per primi. Secondo Raghavan, grazie a MUM può “identificare più di 350 argomenti relativi alla pittura acrilica” e aiutarci a trovare la strada giusta da intraprendere, scandagliando tutte le ricerche intorno a quella specifica query e proponendo alcuni percorsi collaterali. In futuro, “MUM sbloccherà approfondimenti più approfonditi” che potremmo avere difficoltà a cercare – come “come realizzare dipinti acrilici con oggetti domestici” – e metterà gli utenti in connessione “con contenuti sul Web che altrimenti potrebbero non aver incontrato o cercato”.

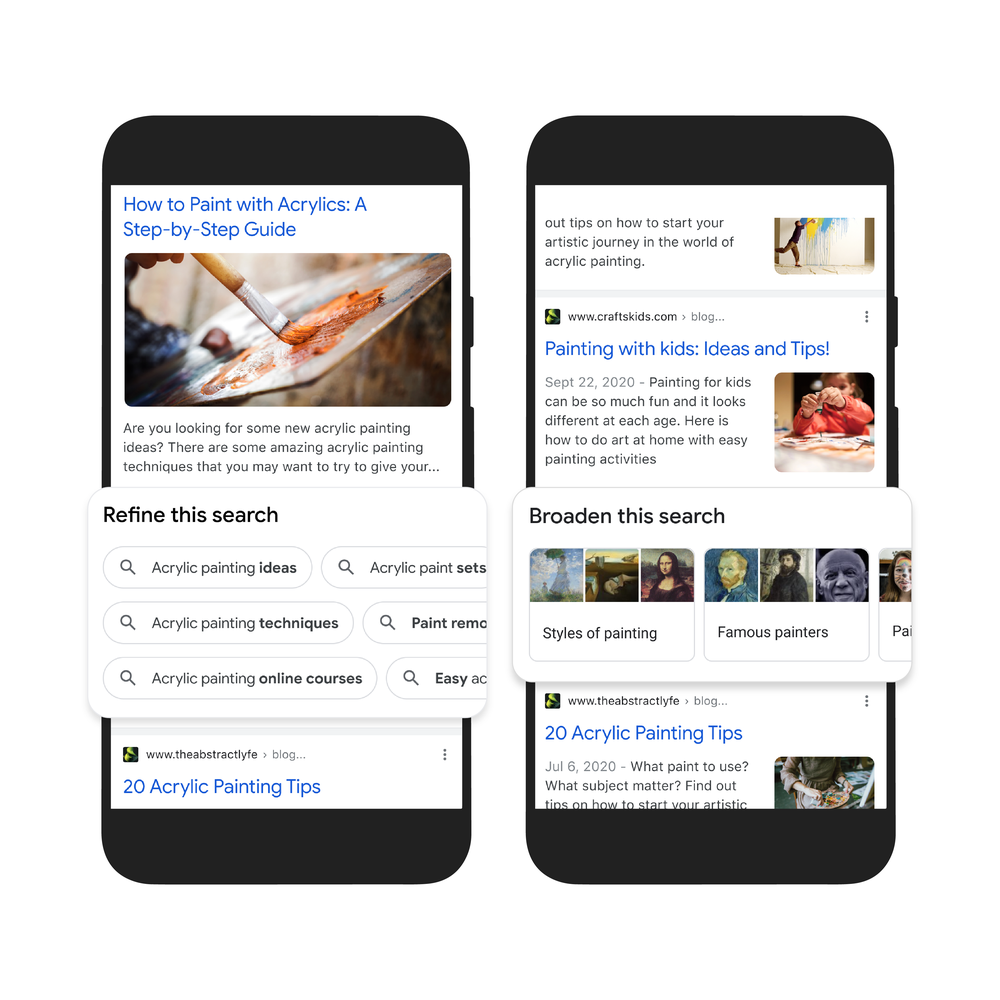

Refine e Broaden this search applicano invece il concetto di zoom in e zoom out alle query, consentendo di intervenire sul livello di profondità della ricerca che abbiamo lanciato, per perfezionarla o ampliarla.

Restando allo stesso esempio precedente della pittura acrilica, con Refine possiamo accettare i suggerimenti di Google per restringere l’argomento a ricerche più specifiche (come Idee per la pittura acrilica o Corsi online di pittura acrilica), o al contrario allargare il tema a topic correlati, come stili di pittura o pittori famosi.

Molto interessante è anche la terza funzionalità anticipata dal senior Vice President di Google, che è già in corso di sperimentazione: si tratta di una nuova interfaccia che semplifica la ricerca di ispirazioni visive con una pagina dei risultati più “visibilmente sfogliabile“. Parliamo cioè di una nuova SERP visiva, progettata per le ricerche di utenti che vogliono ispirazione, che si attiva per determinate query (in particolare quelle che contengono la parola “idea” in aggiunta a una keyword, come “Idee per la decorazione di Halloween” o “Idee per giardini verticali interni”) e rende per l’utente “più facile navigare visivamente per trovare ciò che sta cercando”.

Ad esempio, se cerchiamo “idee con pittura colata” (la tecnica del Puddle Pour), Google ci restituisce una SERP “visivamente ricca di idee provenienti da tutto il Web, con articoli, immagini, video e altro” che possiamo facilmente scorrere.

Altri miglioramenti in arrivo

Le applicazioni di MUM e sistemi di AI non si fermano solo alla Ricerca. È sempre Raghavan a svelare, tra l’altro, che ci saranno passi in avanti per identificare i momenti chiave nei video, grazie all’introduzione di una nuova esperienza che “identifica gli argomenti correlati in un video, con link per approfondire facilmente e saperne di più”.

Utilizzando MUM, sarà possibile anche “mostrare argomenti correlati che non sono esplicitamente menzionati nel video, in base alla nostra comprensione avanzata delle informazioni nel video”.

Ad esempio, anche se nel video qui sopra non sono pronunciate le parole “storia della vita del pinguino macaroni”, i sistemi di Google “capiscono che gli argomenti contenuti nel video si riferiscono a questo argomento, ad esempio il modo in cui i pinguini macaroni trovano i loro familiari e affrontano i predatori”.

Miglioramenti in arrivo anche per About This Result, la feature che fornisce dettagli su un sito web prima che l’utente lo visiti (inclusa la sua descrizione, quando è stato indicizzato per la prima volta e se la connessione al sito è sicura) attiva nella versione di Google USA.

Il pannello delle informazioni si espande ancora – già a luglio avevamo visto l’aggiunta di alcune informazioni legate al ranking – e permette di:

- Visualizzare ulteriori informazioni sulla fonte (“ciò che un sito dice di se stesso con parole sue, quando tali informazioni sono disponibili”).

- Leggere ciò che altri sul Web hanno detto su un sito (notizie, recensioni e altro contesto utile): ovvero, informazioni di terze parti al di fuori di Wikipedia che parlano del sito e del brand.

- Scoprire ulteriori informazioni sull’argomento: nella sezione “Informazioni sull’argomento”, possiamo trovare informazioni come la copertura delle principali notizie o i risultati sullo stesso argomento da altre fonti.

Sempre nell’ottica di migliorare l’esperienza degli utenti che intendono esplorare le informazioni e leggere contenuti affidabili, Google ha lanciato una serie di altri strumenti per aiutano a valutare la credibilità delle informazioni online. Ad esempio, sarà più semplice l’individuazione dei fact check pubblicati da fonti indipendenti e autorevoli sul web, che saranno evidenziati nei risultati in Ricerca, Notizie e Google Immagini; e poi, prosegue il lavoro per offrire il giusto contesto a chi esegue una query informativa, attraverso feature che informano quando informazioni utili o pertinenti non sono ancora disponibili sul Web perché l’evento è in rapida evoluzione, oppure perché semplicemente non esistono le informazioni pertinenti per quella ricerca in quel momento.

MUM e intelligenza artificiale applicate anche allo shopping

Ma l’evento Google Search On 2021 ha fatto anche da scenografia (virtuale) per le anticipazioni sugli approdi dell’Intelligenza Artificiale per lo shopping e per Maps.

Su quest’ultima app, in particolare, compare una nuova feature disponibile su iOS e Android per tutto il mondo a partire da ottobre che permette di individuare approssimativamente il luogo e la dimensione di un incendio in atto, segnalando anche informazioni sui numeri utili da chiamare e sul modo in cui si sta sviluppando il contenimento dell’incendio.

Anche gli acquisti si fanno più intelligenti grazie alla tecnologia, e lo Shopping Graph consente ora di visualizzare un’esperienza di ricerca Google più “acquistabile” per le query relative all’abbigliamento, proponendo direttamente dai risultati di ricerca un feed visivo di prodotti in vari colori e stili (molto più navigabile rispetto a quello attuale), insieme ad altre informazioni utili, come negozi locali, guide sullo stile e video.

Sempre in tema shopping, Google sta aggiungendo un nuovo inventario in negozio per rendere l’esperienza di acquisto online da casa più simile allo shopping di persona in negozio, permettendo di filtrare i risultati cliccando su “in stock” per vedere se i negozi nelle vicinanze hanno tali articoli specifici sui loro scaffali.

Novità in arrivo anche per Google Lens, che sarà implementato anche su browser desktop Chrome: gli utenti potranno dare ricerche di immagini inverse, selezionando immagini, video o testo su un sito per vedere i risultati della ricerca nella stessa scheda. Per i dispositivi mobile, invece, Lens renderà tutte le immagini su una pagina ricercabili. Ancora una volta, quindi, Google cerca di aumentare il traffico delle ricerche commerciali, provando anche a spostare gli utenti su Google Shopping per concludere gli acquisti (dirottandoli da Amazon).

La Ricerca evolve per soddisfare meglio gli utenti

“Non vediamo l’ora di aiutare le persone a trovare le risposte che stanno cercando e di ispirare più domande lungo il percorso”, dice Raghavan nel suo articolo per spiegare gli obiettivi a cui tendono “la creazione di prodotti più utili e l’ampliamento dei confini di ciò che significa cercare“.

L’evento livestream Search On ha fornito a Google l’occasione per condividere quali sono i più recenti approdi in fatto di intelligenza artificiale applicata ai prodotti dell’ecosistema Big G, che offrono alle persone nuovi modi per cercare ed esplorare le informazioni in modi più naturali e intuitivi.

È proprio questo che per Google significa migliorare il motore di ricerca: dare agli utenti “informazioni esplorabili in modo più naturale e intuitivo”, pertanto efficaci e utili, e l’interconnessione dei risultati di ricerca, della multimodalità e delle funzionalità di Google garantita da MUM può offrire nuovi modi per arrivare a ciò che stiamo cercando con una query (o anche senza!).

Oggi “ci sono più informazioni accessibili a portata di mano delle persone che in qualsiasi momento della storia umana”, ma non è sempre facile trovare soddisfazione per i nostri intenti di ricerca: grazie ai progressi nell’intelligenza artificiale però sarà possibile trasformare “radicalmente il modo in cui utilizziamo tali informazioni, con la capacità di scoprire nuove intuizioni che possono aiutarci sia nella nostra vita quotidiana sia nei modi in cui siamo in grado di affrontare complesse sfide globali“, si auspica Raghavan.

Tutto questo lavoro non solo aiuta le persone in tutto il mondo in qualità di utenti di Search, ma anche creatori, editori e aziende: è sempre il VP a ricordare che Google “ogni giorno invia visitatori a oltre 100 milioni di siti Web diversi e ogni mese mette in contatto le persone con più di 120 milioni di attività commerciali che non dispongono di siti Web, consentendo chiamate telefoniche, indicazioni stradali e traffico pedonale locale”.

Google Search On 2021, la SEO deve spaventarsi?

Che impatto avrà tutto questo sulla SEO?

Probabilmente, sul fronte dell’attività di ottimizzazione per la ricerca non cambierà molto, perché l’uso più intenso di MUM non dovrebbe modificare ciò che Google cerca nei contenuti e i criteri con cui stabilisce il ranking, ma solo perfezionare le SERP in base alla query dell’utente – ovvero, creare un match più preciso tra la richiesta/esigenza dell’utente e il contenuto che risponde a questo intento.

Più problematica potrebbe essere la nuova forma visiva delle SERP legate a query ispirazionali, dove il peso dei contenuti testuali classici sembra passare in secondo piano rispetto ad altri strumenti multimediali (elemento da tenere in considerazione per chi opera in questo settore), e dove gli stessi link blu perdono ancora visibilità rispetto ad altre feature più interattive e di più rapida consultazione.

Come dicevamo qualche tempo fa, comunque, il futuro della SEO non è certo in pericolo e, anzi, conoscere in (leggero) anticipo le trasformazioni che vivremo ci permette di prepararci e adattare (noi stessi, mentalmente, e i nostri contenuti/siti) a ciò che ci aspetta. Non possiamo certo controllare Google e le sue evoluzioni, ma possiamo lavorare per stare al suo passo, studiando il modo per sfruttare questi cambiamenti e le nuove feature per ottenere più visibilità e generare più affari e traffico.