Ricerca Google mobile, ora i siti possono attivare le immagini 3D e AR

Era stato uno degli annunci roboanti dell’ultima conferenza Google I/O, attivato poi con una fase di testing per alcuni soggetti specifici: ora la possibilità di visualizzare immagini 3D e in realtà aumentata per le ricerche mobile su Google compie un ulteriore passo in avanti verso la piena operatività, e Burberry è il primo sito esterno a sfruttare questa occasione.

Prodotti Burberry in 3D su Google

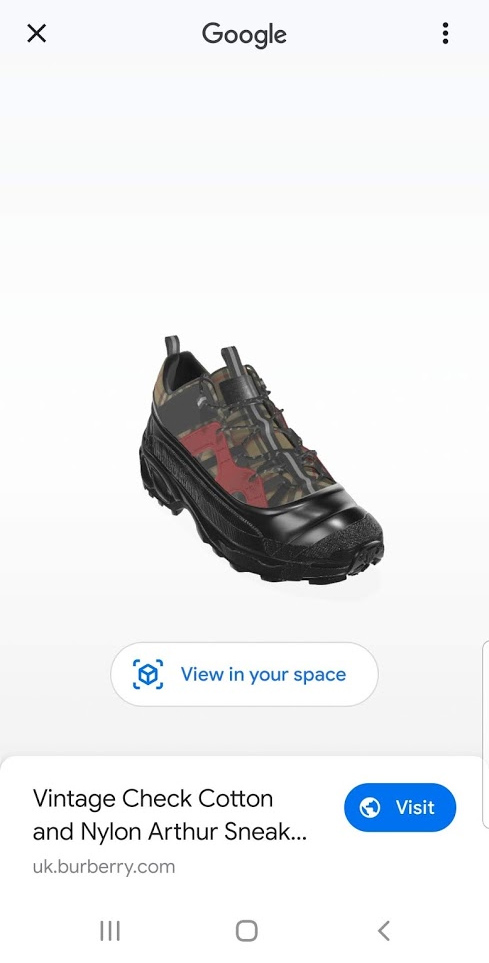

A fine febbraio, la nota casa di moda ha infatti annunciato la partecipazione al programma di sviluppo del nuovo strumento per lo shopping in realtà aumentata collegato alla tecnologia di ricerca di Google da mobile. Disponibile al momento solo sulla versione UK e US del motore di ricerca, e per una serie limitata di prodotti, la funzione permette di vedere l’articolo desiderato in modalità tridimensionale e di posizionarlo anche nell’ambiente circostante tramite la fotocamera del telefono.

Gli esempi Burberry nella Ricerca Immagini di Google

Questo significa che cercando la borsa Burberry Black TB e le sneaker Arthur Check possiamo non solo scoprirne tutti i dettagli, ruotando a piacere il prodotto reso in 3D, ma anche abbinarlo al nostro outfit per verificarne l’accostamento senza dover necessariamente provarla in un negozio fisico.

Un supporto per gli utenti

Burberry ha affermato di aver adottato questa tecnologia perché “la fase di ispirazione sta diventando sempre più importante nel processo della decisione di acquisto per i consumatori di lusso”. Inoltre, l’azienda “sperimenta continuamente innovazioni digitali per fornire un’esperienza più entusiasmante e migliorare il commercio di lusso personalizzato, fondendo la tecnologia con altre attivazioni in tutto il mondo”, al fine di migliorare la sua esperienza online e in negozio.

Come partecipare al beta test della funzione Google

Burberry collabora come pioniere nella sperimentazione di questa feature di Google Immagini, che quindi esce dai confini precedenti – era limitato sostanzialmente alle ricerche di alcuni tipi di animali – e inizia a essere a disposizione anche di siti terzi. Barry Schwartz ha scoperto che esiste una pagina per sottoporre la propria candidatura come beta tester a Google – 3D & AR results in Google Search interest form – che fa riferimento anche alle linee guida cui gli sviluppatori interessati devono attenersi.

Qui si legge che “i risultati 3D e di realtà aumentata (AR) aiutano le persone a visualizzare i tuoi contenuti 3D direttamente dai risultati della Ricerca Google”. In particolare, gli utenti che toccano il chip Visualizza in 3D sono “coinvolti in un’esperienza immersiva in cui possono interagire con la risorsa 3D o persino inserirla nel loro spazio con la tecnologia AR” e – notizia importante in termini di utilità per i siti – possono “toccare un chip per continuare sul tuo sito web o uscire per tornare alla pagina dei risultati della Ricerca Google”.

Il vantaggio per i siti: nuovi potenziali clienti e conversioni

Il sistema quindi può servire a portare nuovi utenti e potenziali clienti verso il sito, incuriositi dalla visualizzazione tridimensionale del prodotto e dalla “prova camerino” virtuale. Da tempo Google invita a non sottovalutare le potenzialità della ricerca Immagini, e con questa innovazione offre un’ulteriore prova di come le immagini possono servire non solo a catturare l’attenzione, ma anche a portare nuove conversioni.

In chiave futura, la funzione servirà per mostrare 3 tipologie di contenuti:

- Modelli di prodotto per le pagine dei prodotti

- Oggetti o personaggi famosi del mondo dell’intrattenimento che prendono vita in 3D

- Contenuti didattici che risultano più efficaci e comprensibili in 3D

Google al lavoro sulle immagini 3D

Ma questo è solo uno dei fronti dell’attività di sviluppo di Google: sul blog Google AI è stato infatti annunciato il rilascio di MediaPipe Objectron, un sofisticato software che riesce a fornire una pipeline mobile di rilevamento di oggetti 3D in tempo reale per cose di uso quotidiano (attualmente, sedie e scarpe).

Questa pipeline rileva oggetti nelle immagini 2D e ne stima le pose e le dimensioni attraverso un modello di machine learning (ML), formato su un dataset 3D appena creato: in questo modo, determina la posizione, l’orientamento e le dimensioni degli oggetti di uso quotidiano in tempo reale sui dispositivi mobili, portando a una varietà di applicazioni in robotica, veicoli a guida autonoma, recupero di immagini e realtà aumentata.