Arriva Google BERT, il nuovo algoritmo per interpretare le query

Il sistema della Ricerca di Google sta per affrontare un cambiamento quasi epocale: dal 25 ottobre è stato infatti rilasciato ufficialmente il nuovo algoritmo di ricerca chiamato Google BERT che, come scrive Pandu Nayak sul blog The Keyword, consentirà a Google di “capire le ricerche nel modo migliore di sempre” grazie agli sviluppi di machine learning e studi sulla comprensione delle lingue.

Cos’è Google BERT, nuovo algoritmico tecnologico per le ricerche

BERT è l’acronimo di Bidirectional Encoder Representations from Transformers, ovvero letteralmente Rappresentazioni di encoder bidirezionali da trasformatori: questa sigla definisce la tecnica di rete neurale di Google per la pre-formazione dell’elaborazione del linguaggio naturale. In sintesi, tutto questo significa che BERT può aiutare le macchine a comprendere il linguaggio in modo un po’ più simile e vicino a quanto fanno gli esseri umani.

L’algoritmo è stato messo in funzione già agli inizi di questa settimana per le ricerche in lingua inglese e, come anticipato da Nayak, sarà definitivamente attivo a breve e presto si espanderà anche alle altre lingue. Possiamo già dare una notizia utile a chi fa SEO e si sta preoccupando: l’identificazione del search intent di SEOZoom continuerà a funzionare come prima, perché il nostro software è adattivo e quindi offrirà gli stessi suggerimenti validi anche con BERT!

Il più grande salto in avanti della Ricerca di Google

Google BERT è “il più grande passo avanti negli ultimi cinque anni e uno dei più grandi salti in avanti nella storia della Ricerca“, scrive senza mezze misure Pandu Nayak facendo riferimento alla precedente grande modifica del sistema di ricerca, l’introduzione di RankBrain avvenuta appunto circa cinque anni fa.

Google BERT modificherà il 10 per cento delle query

Tali aspettative sembrano confermate dalle prime indiscrezioni sugli effetti dell’algoritmo BERT, che secondo Google avrà un impatto su una query su 10, modificando le posizioni dei risultati che si classificano per tali query, e che inoltre sarà utilizzato a livello globale per tutte le feature delle SERP, compresi i featured snippet.

BERT e RankBrain per Google

È importante comunque sapere che BERT non sostituisce RankBrain, ma è un metodo aggiuntivo per comprendere contenuti e query, che sarà usato per definire meglio i risultati rilevanti. Come spiega Google, ci sono molti modi di comprendere “cosa vuol dire il linguaggio usato nella tua query e come si collega ai contenuti sul web”. Ad esempio, se facciamo un errore (misspelling), i sistemi di ortografia di Google possono aiutarci a trovare la parola giusta per ottenere ciò che vogliamo, così come Google può abbinare termini sinonimi trovati nei documenti pertinenti. BERT diventa perciò un altro segnale che Google utilizza per comprendere la lingua e fornire un risultato pertinente.

Come funziona l’algoritmo Google BERT

Questa grande rivoluzione parte da lontano, e Nayak ricorda che un anno fa Google ha introdotto e reso open source una tecnica basata sulla rete neurale per la pre-formazione dell’elaborazione del linguaggio naturale, chiamata Rappresentazioni di encoder bidirezionali dai trasformatori, che è per l’appunto l’odierno BERT. Questa tecnologia consente a chiunque di addestrare il proprio sistema di risposta alle domande allo stato più evoluto.

Si tratta del frutto dell’intenso lavoro delle ricerche compiute sui trasformatori: modelli che elaborano le parole in relazione a tutte le altre parole in una frase, anziché una per una in ordine. I modelli BERT possono quindi considerare l’intero contesto di una parola osservando le parole che la precedono e seguono, e questo è particolarmente utile per comprendere l’intento alla base delle query di ricerca.

Gli effetti di Google BERT sulle SERP

In concreto, BERT aiuta a comprendere meglio le sfumature e il contesto delle parole nelle ricerche e ad abbinare meglio quelle query con risultati più pertinenti. Nel suo articolo, Pandu Nayak ha mostrato alcuni esempi dei cambiamenti apportati dal nuovo algoritmo su alcune SERP:

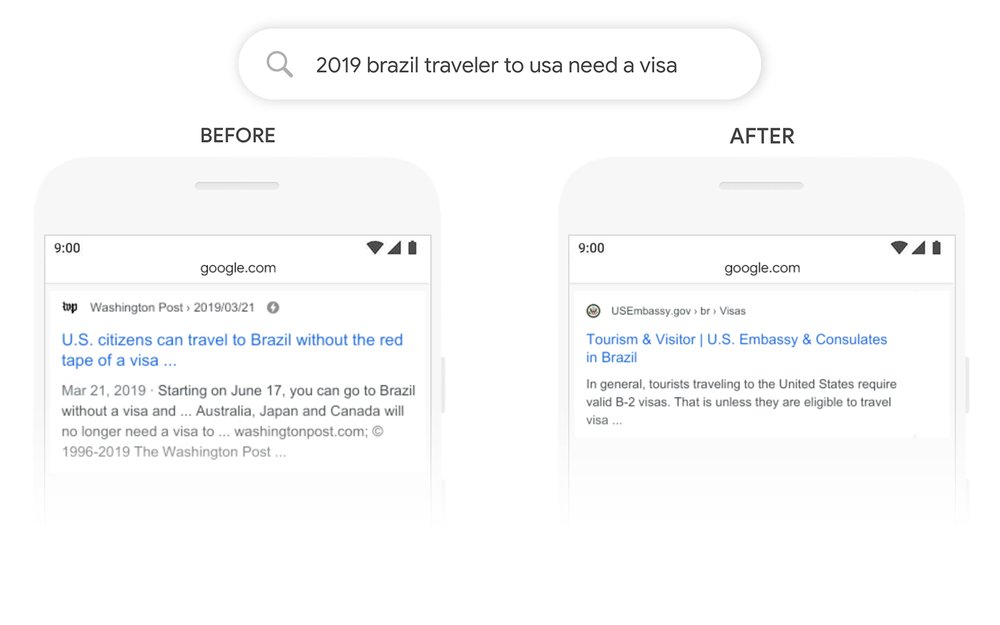

- 2019 brazil traveler to usa need a visa

In questo caso, la parola “to” e la sua relazione con gli altri termini assume un nuovo rilievo: in precedenza, Google non capiva l’importanza di questa connessione e restituiva risultati sui cittadini statunitensi che viaggiano in Brasile. Ora, grazie a BERT, l’algoritmo di Ricerca “è in grado di cogliere questa sfumatura e sapere che la parola molto comune to in realtà conta molto qui, e possiamo fornire un risultato molto più pertinente per questa query”.

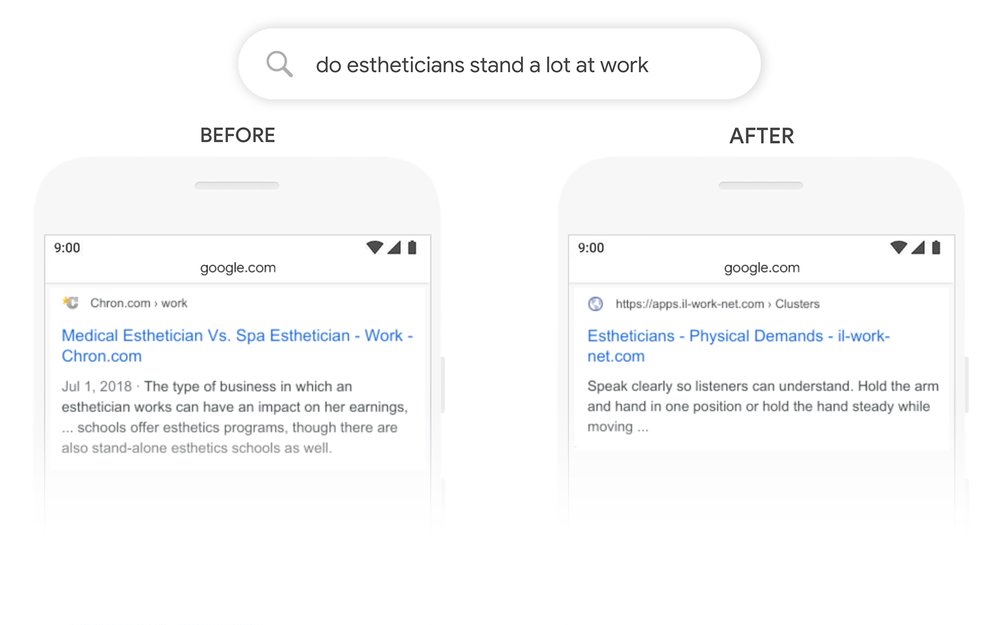

- do estheticians stand a lot at work

Per questa query, prima Google avrebbe unito l’espressione “stand-alone” alla parola “stand” usata nella query; con BERT comprende meglio che lo “stare in piedi” è legato al concetto delle esigenze fisiche di un lavoro e mostra una risposta più utile.

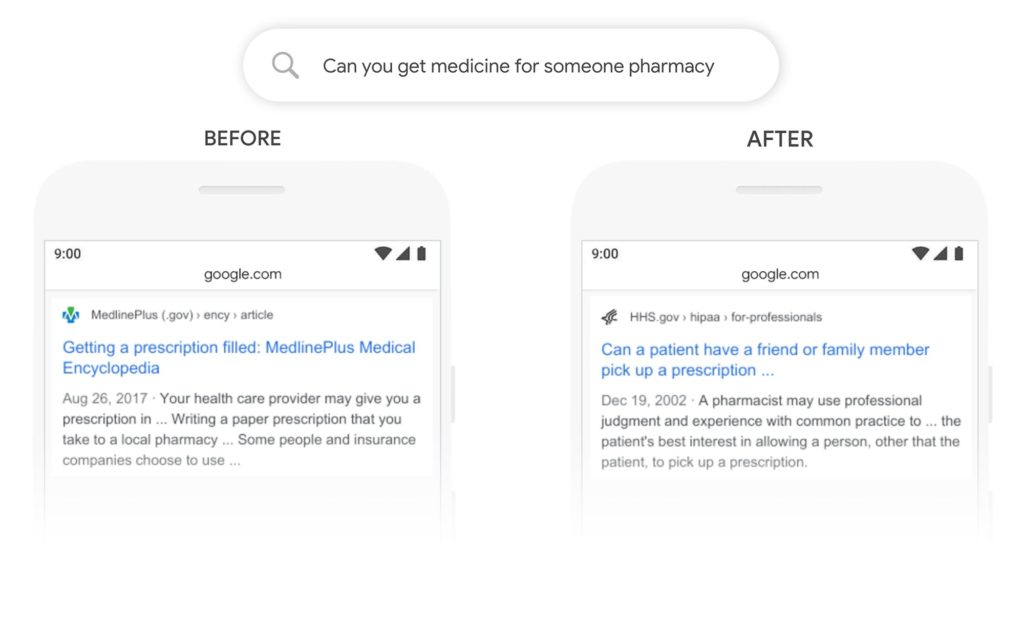

- can you get medicine for someone pharmacy

Ora Google interpreta la query in modo più umano, mostrando risultati più pertinenti rispetto alla richiesta di “prendere farmaci per qualcuno”.

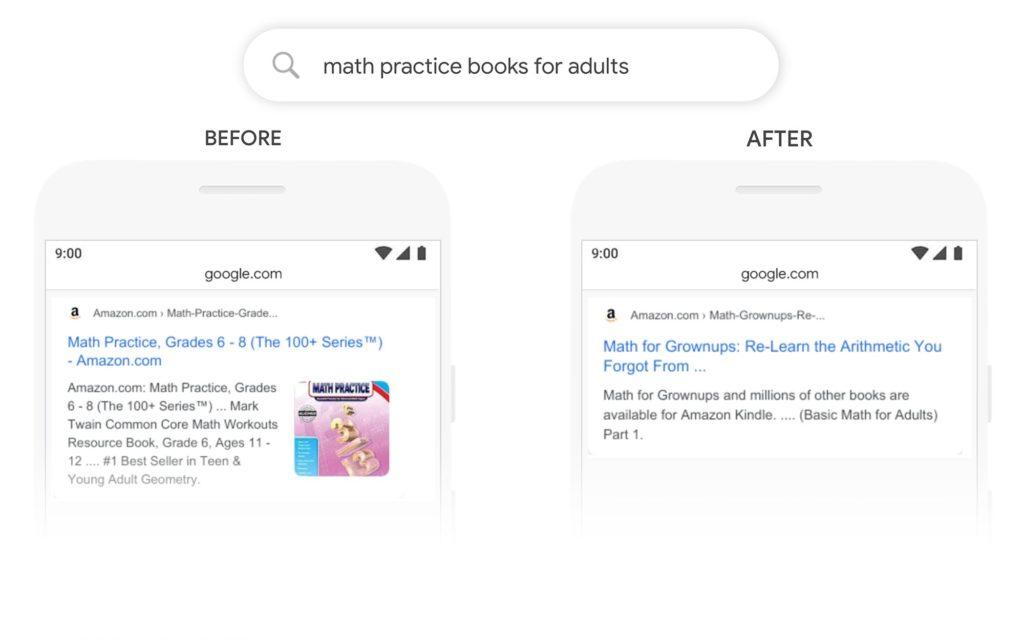

- math practice book for adults

Mentre prima la SERP includeva un libro di categoria “young adult”, BERT collega meglio il termine adulto al contesto, restituendo un risultato migliore e più appropriato.

Il cambiamento sui featured snippet

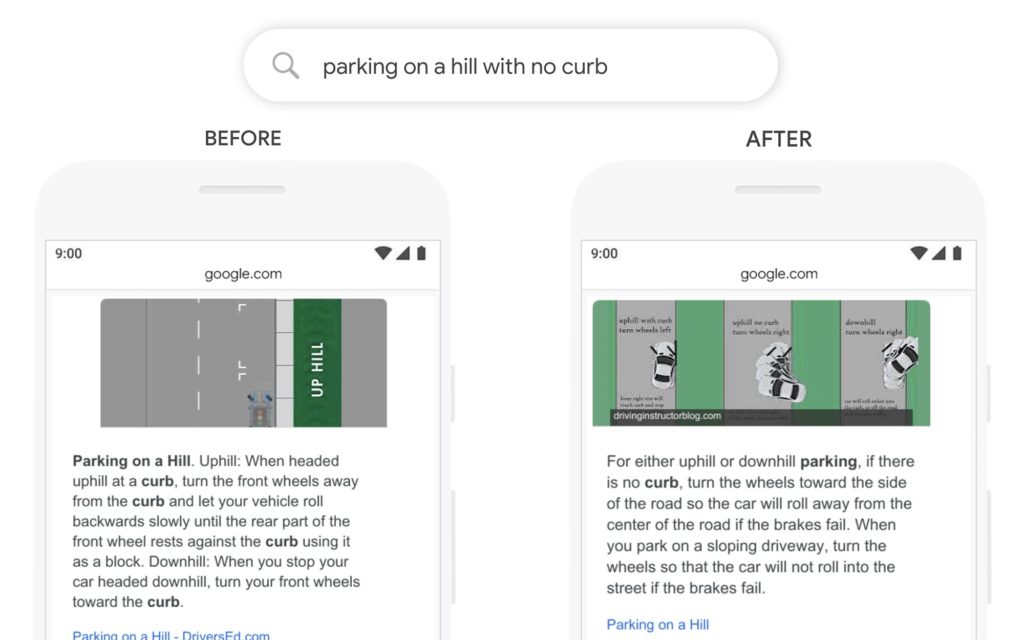

Come dicevamo, il nuovo algoritmo impatta anche sui risultati zero, e l’esempio concreto scelto per mostrare la differenza tra “prima e ora” riguarda la query “Parking on a hill with no curb” (ovvero, Parcheggio su una collina senza marciapiede). Questa richiesta in precedenza “avrebbe confuso i sistemi di Google”, ammette Nayak, perché si sarebbero focalizzati sul termine curb ignorando il centrale no, fondamentale per rispondere in modo appropriato (e infatti il feature snippet proposto parlava genericamente di parcheggio in collina con marciapiede, esattamente l’opposto), mentre ora la comprensione è maggiore e migliore.

Migliorare la Ricerca in più lingue

Pandu Nayak anticipa anche l’applicazione di BERT per migliorare il sistema di ricerca per le persone in tutto il mondo: questi sistemi hanno la potente caratteristica di prendere gli insegnamenti da una lingua e applicarli ad altre, e quindi sarà possibile prendere modelli che apprendono dai miglioramenti dell’inglese (la lingua che fornisce la stragrande maggioranza dei contenuti Web) e applicarli ad altre lingue, così da fornire risultati pertinenti in modo più valido ed efficace in tutte le lingue in cui è offerto Google Search.

Il lavoro su Search continua

Tuttavia, il vicepresidente di Google Search dice che la “Ricerca non è un problema risolto”: la comprensione della lingua umana rimane una sfida continua e Google si sta impegnando per migliorare a trovare il significato insito nelle query che si eseguono sul motore di ricerca e a fornire le informazioni più utili.

E qualche errore continua a permanere, anche con BERT: se cerchi “what state is south of Nebraska”, anche il nuovo algoritmo si limita a proporre come miglior risultato una comunità chiamata “South Nebraska”, ignorando lo Stato del Kansas che sarebbe la risposta ottimale.